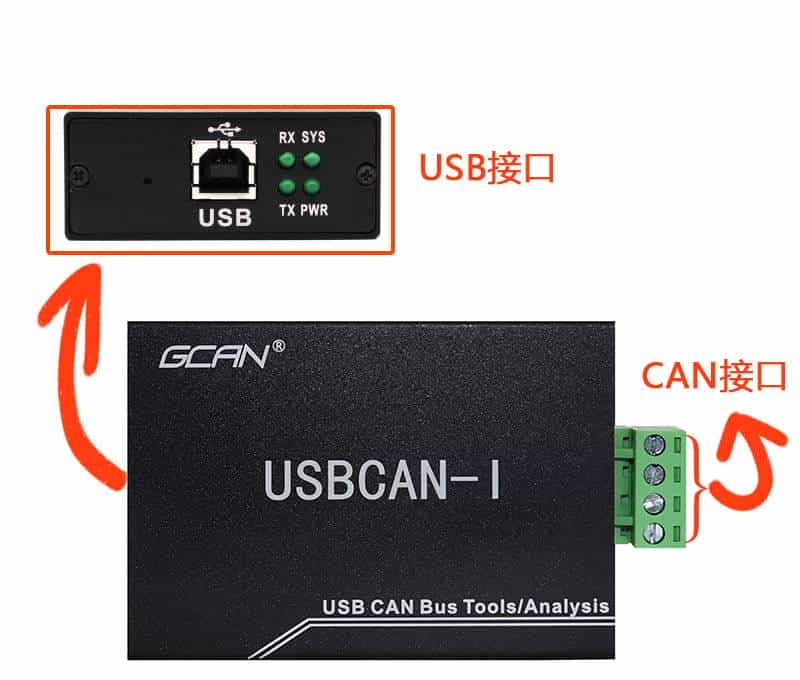

USBCAN作为最常用的CAN总线分析仪而流行,由于它不仅使用起来方便,而且功能还超级的强劲,通过USB转CAN模块,可以分析CAN总线中的信号,专业工程师还可以根据分析得到的信号进行二次开发等。

接下来我们来说说USBCAN的前世是怎样的。USB转CAN模块是一个看起来很简便的小盒子,但是其内部却是超级的强劲,USBCAN可以采集CAN总线上的信号,然后通过它的USB接口将信号传输到PC端的软件上。

最初,USBCAN这种设备也是只有单向通道的CAN接口,不过设备实现的功能基本满足了工程师所需,读取CAN总线信号、分析CAN总线数据。

那么,USBCAN发展到今天又进化成怎样的形态呢?我们下篇文章为你揭晓这个答案。欢迎大家找我讨论更多CAN总线相关的问题。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...