关于NLP 领域顶会ACL的方方面面

ACL(Association for Computational Linguistics)是 NLP 领域的“顶会”,相当于计算机视觉界的 CVPR 或机器学习界的NeurIPS。它每年举办一次,2025 年是第63届。发表的论文代表了当前 NLP 最前沿的研究方向和技术突破,其论文主题始终引领着学术与工业界的研究风向。虽然 ACL 是顶级会议,但不是所有发表的论文都是“革命性”的;有些论文只是小改善,或者复现别人的工作;真正有价值的,是你能从中学到什么、能否应用或改善。✅ 正确态度:把 ACL 当作“信息源”而不是“崇拜对象”。

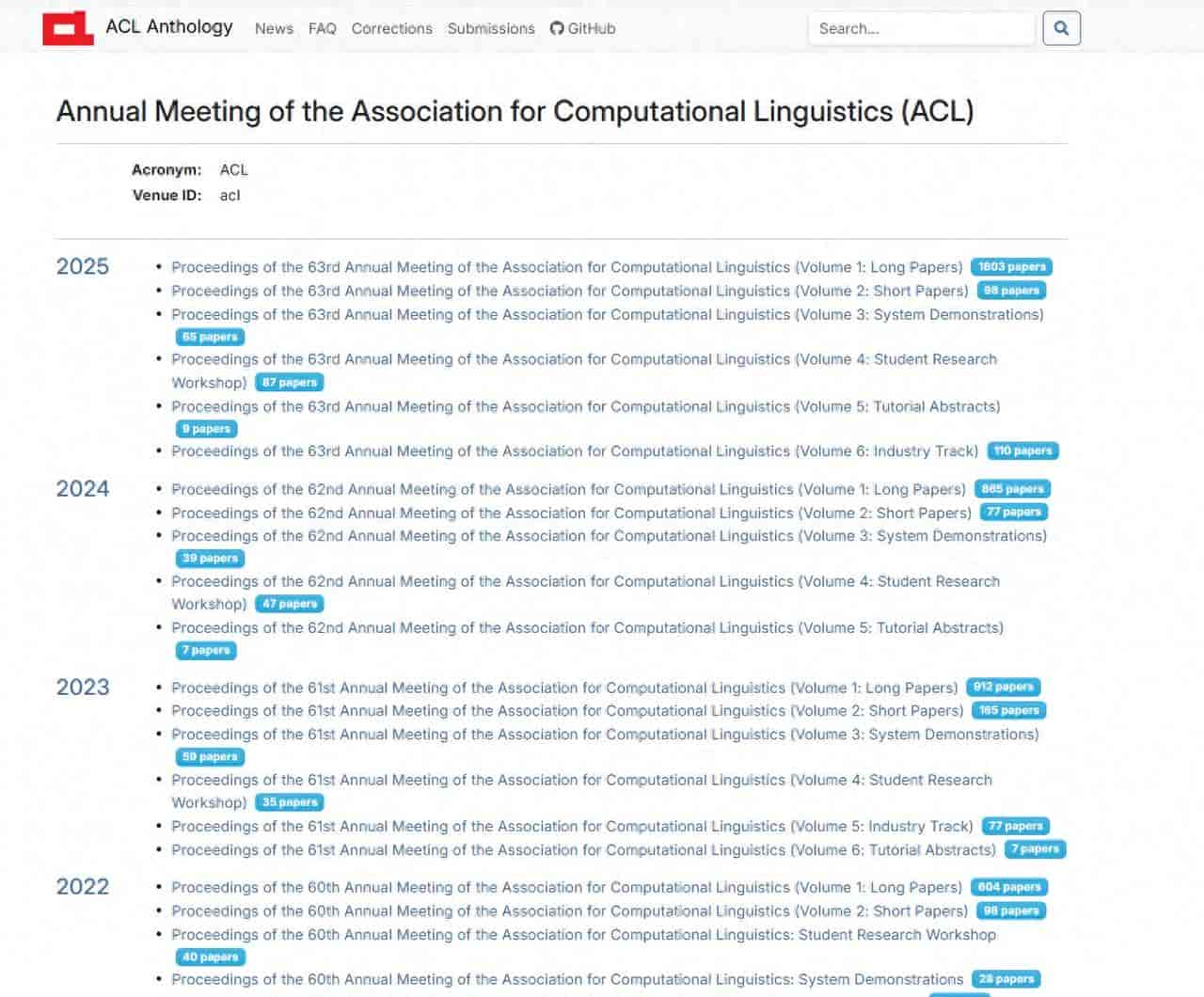

ACL Anthology(计算语言学协会年会论文集),它是自然语言处理(NLP)领域最权威、最具影响力的国际会议之一——ACL(Association for Computational Linguistics) 的官方论文库。要高效、有“得要领”地阅读 ACL 年会的文章,不能像读小说一样从头到尾看,而是要根据你的目标、背景和需求进行策略性阅读。

|

学生/初学者 |

先看综述、教程、经典工作,建立知识框架 |

|

研究人员 |

找自己方向的最新进展,精读关键论文 |

|

工程师/开发者 |

关注系统演示(System Demo)、工业界投稿(Industry Track) |

|

想写论文的人 |

学习写作结构、实验设计、图表呈现方式 |

学会“分类筛选” —— 别被1600+篇吓倒!以 2025 年为例:

|

卷号 |

类型 |

数量 |

推荐程度 |

|

Volume 1 |

长论文(Long Papers) |

1603 篇 |

⭐⭐⭐⭐⭐(核心) |

|

Volume 2 |

短论文(Short Papers) |

98 篇 |

⭐⭐⭐(快速了解新想法) |

|

Volume 3 |

系统演示(System Demos) |

65 篇 |

⭐⭐⭐⭐(实用技术落地) |

|

Volume 4 |

学生研讨会Student Workshop) |

87 篇 |

⭐⭐(适合新手练手) |

|

Volume 5 |

教程摘要(Tutorial Abstracts) |

9 篇 |

⭐⭐⭐⭐⭐构建知识体系 |

|

Volume 6 |

行业方向(Industry Track) |

110 篇 |

⭐⭐⭐⭐(实际应用案例) |

✅ 推荐优先级顺序:教程 > 长论文 > 系统演示 > 短论文 > 工业界 > 学生研讨

|

步骤 |

方法 |

目标 |

|

1. 看标题 + 摘要 |

30秒内判断是否相关 |

是否值得继续读? |

|

2. 看图示 + 表格 |

快速扫一眼图1、图2、Table 1 |

理解模型结构或主要结果 |

|

3. 看引言最后一段 |

找出“本文贡献” |

作者说自己做了啥创新? |

|

4. 看结论 + 实验部分 |

看最终效果对比 |

这个方法真的有效吗? |

|

5. 精读方法章节 |

只读你感兴趣的部分 |

深入理解技术细节 |

用浏览器高亮关键词(如 “prompt”, “fine-tuning”, “zero-shot”)用 PDF 注释工具(如 Adobe Acrobat、Zotero)标记重点句把每篇论文总结成一句话:“这篇文章解决了XX问题,用了YY方法,效果比ZZ好。”

一、ACL 论文中哪些主题最热门?(2024–2025 趋势)

根据 ACL 2024 和 ACL 2025 的官方数据、获奖论文及社区分析,当前最热门的主题可归纳为以下六大方向:

1.大语言模型(Large Language Models, LLMs)

- 核心议题:推理能力提升、长上下文建模、高效微调(如 LoRA、QLoRA)、模型对齐(Alignment)、安全与越狱防护。

- 代表工作:《How Johnny Can Persuade LLMs to Jailbreak Them》(ACL 2024)探讨说服性提示攻击 ;《A Theory of Response Sampling in LLMs》(ACL 2025 最佳论文)揭示LLM输出中的“理想化偏移”现象 。

2.多模态智能(Multimodal AI)

- 涵盖任务:图文理解、视频描述、视觉问答(VQA)、跨模态检索、科学图表理解。

- 代表工作:《Can Multimodal Foundation Models Understand Schematic Diagrams?》提出 MISS-QA 基准 ;《Centurio: On Drivers of Multilingual Ability of Large Vision-Language Model》构建支持100种语言的视觉语言模型 。

3.模型对齐与价值观塑造

- 研究焦点:偏好优化(如 DPO、SimPO)、多目标对齐、奖励建模、伦理与公平性。

- 代表工作:美团团队提出的 AMoPO(自适应多目标偏好优化),无需奖励模型即可实现多维度对齐 ;Agent-RewardBench:首个统一评估多模态智能体奖励建模能力的基准 。

4.高效训练与数据工程

- 关键突破:高质量数据筛选、低资源训练、算力优化。

- 代表工作:Meta-rater(ACL 2025 最佳主题论文):仅用1%算力预测最优预训练数据组合,显著提升模型性能 ;强调“教育价值”“推理深度”等新质量维度,颠覆传统“写作风格”优先的观念。

5.数学与复杂推理

- 新兴方向:形式化推理、过程监督、错误定位。

- 代表工作:阿里巴巴 Qwen 团队提出的 ProcessBench:评测大模型在数学解题中识别首个错误步骤的能力 ;开源模型 Qwen2.5-32B 在批判性推理上媲美 GPT-4o。

6.低资源与多语言 NLP

- 目标:打破英语中心主义,支持非洲、东欧、南亚等低资源语言。

- 代表工作:BRIGHTER 数据集(ACL 2025 最佳资源奖):覆盖28种语言的情绪识别数据,支持多标签+强度标注 ;COSMMIC:包含9种印度语言的多模态摘要语料库 。

✅ 总结趋势:从“追求性能指标”转向“关注模型行为、价值观、可解释性与普惠性”。

二、如何快速找到关键论文方向?

方法 1:追踪 ACL 官方奖项与亮点

- 最佳论文(Best Paper):代表理论或应用的重大突破;

- 杰出论文(Outstanding Paper):高影响力工作;

- SAC Highlights(Senior Area Chairs 推荐):由领域主席精选的前沿方向 ;

- 最佳主题论文(Best Theme Paper):如 Meta-rater 聚焦“数据质量”这一年度主题 。

方法 2:利用关键词搜索 + 引用量排序

在 ACL Anthology 中使用:

1"large language model" site:2025.acl

2"multimodal" site:2025.acl-long或结合 Google Scholar 按引用量排序。

方法 3:阅读综述与教程

- ACL 每年设有 Tutorial Track,提供领域全景图;

- 例如 2025 年有《Multimodal Large Language Models for Text-rich Image Understanding: A Comprehensive Review》。

方法 4:关注华人团队与工业界投稿

- 华人团队在 ACL 2024–2025 表现突出:华中科大甲骨文破译、上海AI Lab Meta-rater、美团生成式检索等 [4][6];

- 工业界论文(Industry Track)往往指向落地场景,如外卖搜索、相关词推荐 。

方法 5:使用 AI 辅助工具

- Papers With Code:查看开源代码与排行榜;

- Semantic Scholar:自动提取论文贡献;

- Paper Digest 类公众号(如“学姐带你玩AI”)提供中文解读 。

三、学习 ACL 论文的推荐资源

官方平台

|

资源 |

说明 |

|

ACL Anthology |

免费下载所有 ACL、EMNLP、NAACL 等会议论文 |

|

ACL Rolling Review(ARR) |

新投稿机制,全年滚动审稿,可提前获取预印本 |

学习社区与工具

|

资源 |

特点 |

|

Zotero + ACL 插件 |

自动抓取元数据,管理文献库 |

|

Hugging Face Papers |

关联模型与论文,一键试用 |

|

YouTube ACL Talks |

官方录制作者讲解视频(部分开放) |

|

Reddit r/MachineLearning |

社区讨论热点论文 |

中文辅助资源

|

来源 |

内容 |

|

CSDN / 知乎 / 微信公众号(如“学姐带你玩AI”) |

提炼创新点、提供代码链接 [7] |

|

《计算语言学导论》(冯志伟等) |

打好理论基础 |

|

清华大学 NLP 组阅读列表 |

新手入门必读经典 |

️ 实践提议

- 复现经典论文:从 ACL 2020–2022 的高引工作开始(如 BERT、T5);

- 参与 Kaggle / 天池竞赛:将 ACL 方法应用于实际任务;

- 写论文笔记:用“问题-方法-实验-不足”四段式总结每篇论文。

核心要点:不要尝试读完所有论文,而是围绕一个子问题深挖3–5篇高质量工作,比泛读50篇更有价值。

三、进阶提议:如何系统性学习 ACL 论文?

1.从“综述”开始

- 查找 Tutorial Abstracts(教程摘要)或搜索关键词 “survey”、”review”。

- 推荐读物:《A Survey on Large Language Models》《The Evolution of Prompt Engineering》《Zero-Shot Learning in NLP: A Review》

示例链接:

https://aclanthology.org/2025.acl-long.1

2.关注“热点趋势”

- 每年 ACL 的主题都反映行业风向:2023–2024:大模型、推理、对齐2025:多模态、Agent、可解释性、可持续AI

- 可通过 ACL Anthology 的搜索框 输入关键词如:large language modelin-context learningmodel compressionethical AI

3.利用工具辅助阅读

|

工具 |

功能 |

|

Zotero / EndNote |

管理参考文献 |

|

Semantic Scholar |

自动提取论文关键点 |

|

Paperpal / Grammarly |

修改英文写作 |

|

DeepL / Google Translate |

辅助翻译非母语论文 |

四、实战提议:给不同人群的具体策略

学生 & 新手:

- 先读 教程(Tutorial) 和 短论文(Short Paper)

- 选择一个子方向(如“文本生成”、“情感分析”),聚焦阅读

- 用思维导图整理知识点

研究者 & 博士生:

- 每周精读 1–2 篇 长论文

- 关注 实验设计 和 基线设置 是否合理

- 思考:“这个方法能不能迁移到我的任务上?”

工程师 & 产品经理:

- 重点看 系统演示(System Demo) 和 Industry Track

- 关注哪些技术可以产品化落地

- 列如:某公司展示了一个轻量级中文大模型,部署在手机端,延迟<100ms → 这就是有价值的信息!

附注:当下ACL最值得投入深度研究的五大方向,每个方向均附有代表性工作、核心挑战与未来机会:

1.大模型的「可靠推理」能力(Reliable Reasoning) 为什么重大?当前 LLM 虽能生成流畅文本,但在数学、逻辑、科学等领域常“一本正经地胡说八道”(幻觉)。如何让模型像人类一样分步思考、自我验证、识别错误,是通向通用智能的关键。

✅ 代表工作:

- ProcessBench(Qwen 团队, ACL 2025):提出新评测基准,要求模型定位解题过程中的首个错误步骤,而非仅判断最终答案对错。

- Chain-of-Thought + Self-Consistency:通过多路径推理投票提升准确性。

- 形式化验证集成:将 Coq、Lean 等证明助手与 LLM 结合。

核心挑战:

- 如何建模“不确定性”并主动拒绝回答?

- 如何实现跨任务迁移的推理框架?

- 推理过程是否可解释、可干预?

研究机会:

- 构建 “批判性思维”训练数据集

- 设计 过程监督(Process Supervision)算法

- 探索 神经符号混合系统

✅ 适合人群:理论扎实、关注AI安全与可信性的研究者。

2.高效、公平、可持续的大模型训练

为什么重大?

当前 LLM 训练依赖海量数据与算力,成本高昂且碳足迹巨大。同时,“高质量数据”的定义模糊,导致模型偏见固化。如何用更少资源训练更好、更公平的模型,是行业刚需。

✅ 代表工作:

- Meta-rater(上海 AI Lab & 华东师大, ACL 2025 最佳主题论文):

通过 25 维质量指标(如“教育价值”“推理深度”)+ 小代理模型,仅用 1% 算力筛选最优预训练数据,性能提升 3.23%。 - DataComp for Language Models:构建标准化数据消融实验平台。

核心挑战:

- 如何量化“数据质量”?传统指标(如 perplexity)失效。

- 如何避免数据筛选放大社会偏见?

- 如何实现 绿色 AI(Green AI)?

研究机会:

- 提出 新型数据评分维度(如文化包容性、实际密度)

- 开发 低资源预训练策略

- 构建 开源、透明的数据筛选工具链

✅ 适合人群:关注 Data-Centric AI、计算效率与伦理的研究者。

3.多模态基础模型的「深度理解」能力

为什么重大?

当前多模态模型(如 LLaVA、Qwen-VL)擅长图文匹配,但无法理解科学图表、工程图纸、医学影像中的抽象关系。这限制了其在科研、医疗、工业等高价值场景的应用。

✅ 代表工作:

- MISS-QA(ACL 2025):首个评估模型理解科学论文示意图能力的基准,发现现有模型与人类专家差距显著。

- Agent-RewardBench:统一评测多模态智能体在感知、规划、安全上的奖励建模能力。

核心挑战:

- 如何建模跨模态的因果与逻辑关系?

- 如何让模型理解非自然图像(如电路图、化学结构式)?

- 缺乏高质量、细粒度标注的多模态数据。

研究机会:

- 构建 领域专用多模态语料库(如法律文书+判决书、医学报告+影像)

- 探索 视觉符号系统(Visual Symbolic Systems)

- 研究 多模态提示工程

✅ 适合人群:有计算机视觉或特定领域知识(如生物、法律)背景者。

4.价值观对齐与多目标优化

为什么重大?

实际应用中,用户期望模型同时满足:有用、无害、诚实、拟人、符合本地文化。但这些目标常相互冲突(如“诚实” vs “礼貌”)。如何动态平衡多目标,是产品落地的核心难题。

✅ 代表工作:

- AMoPO(美团, ACL 2025):无需奖励模型,通过自适应采样实现多目标偏好优化,显著降低计算开销。

- CMAQ:在搜索词推荐中联合优化点击率与主题延展性。

核心挑战:

- 如何定义和量化“价值观”?

- 如何避免对齐过程导致模型“过度保守”?

- 多目标之间是否存在帕累托最优解?

研究机会:

- 构建 细粒度人类偏好数据集(按文化、年龄、职业分层)

- 开发 在线多目标对齐框架

- 探索 个性化对齐(Personalized Alignment)

✅ 适合人群:对人机交互、社会计算、强化学习感兴趣者。

5.低资源语言与去中心化 NLP

为什么重大?

全球 7000+ 种语言中,95% 缺乏数字资源。当前 LLM 高度英语中心化,加剧数字鸿沟。让 AI 服务全人类,不仅是技术问题,更是伦理责任。

✅ 代表工作:

- BRIGHTER 数据集(ACL 2025 最佳资源奖):覆盖 28 种语言的情绪识别,支持多标签+强度标注。

- Aya 模型(Cohere, ACL 2024):支持 101 种语言,超半数为低资源语言。

核心挑战:

- 如何在无标注数据下进行有效迁移?

- 如何保护原住民语言的文化独特性?

- 如何构建社区驱动的 NLP 生态?

研究机会:

- 开发 零样本跨语言迁移新范式

- 与语言学家合作构建 音素-语义联合表明

- 设计 轻量级本地化部署方案

✅附注:ACL 近年来在“与医疗相关的 NLP 技术”方面有显著突破,这些技术间接涉及医疗伦理问题,ACL 中与“医疗伦理”相关的三大技术方向

1.临床文本理解中的隐私保护与去标识化(De-identification)伦理问题:电子病历包含大量敏感个人信息,如何在用于科研时保护患者隐私?ACL 突破:开发高精度 命名实体识别(NER) 模型,自动识别并移除姓名、身份证号、住址等 PHI(Protected Health Information)。如 ACL 2023 论文《Privacy-Preserving Clinical Note Generation via Adversarial De-identification》提出对抗去标识化框架,在保留语义的同时消除身份信息。伦理意义:平衡数据可用性与患者隐私权,符合 HIPAA/GDPR 等法规要求。

2.医疗大模型的偏见检测与公平性(Bias & Fairness)伦理问题:AI 在诊断或分诊中是否对不同性别、种族、年龄群体存在系统性偏见?ACL 突破:构建 医疗公平性评测基准,如 MedBIAS(ACL 2024 Workshop)、FairMedEval。分析 LLM 在生成诊疗提议时是否存在“男性优先”“白人偏好”等隐性偏见。提出 去偏微调方法(如 FairPrompt、Adversarial Debiasing)。代表工作:ACL 2025: 《Measuring and Mitigating Social Bias in Clinical Language Models Across 12 Demographic Dimensions》伦理意义:推动算法公平,防止 AI 加剧医疗不平等。

3.患者沟通与可解释性(Explainability & Patient-Centered AI)伦理问题:医生或 AI 向患者解释病情时,是否使用了可理解、无误导的语言?是否尊重患者自主权?ACL 突破:开发 医患对话生成模型,能根据患者教育水平调整语言复杂度。研究 简化医学术语(Medical Text Simplification) 技术,将专业报告转为通俗语言。构建 不确定性表达模型,让 AI 在不确定时说“我不确定”,而非编造答案。代表工作:ACL 2024: 《Generating Uncertainty-Aware Clinical Summaries for Patient Communication》伦理意义:支持知情同意和患者赋权,符合“尊重自主”原则。

4.大模型伦理可靠性,涵盖以下医疗知识增强、幻觉检测、循证推理、安全对齐与评估基准等方面的研究成果:

✅ 1.FRAME: Feedback-Refined Agent Methodology for Enhancing Medical Research Insights;会议:ACL 2025(主会录用)机构:中国科学院合肥物质院 + 华南理工大学链接:

https://arxiv.org/abs/2505.04649 核心贡献:提出 FRAME 框架,通过“生成–评估–反思”三方智能体架构,迭代优化医疗洞见质量。Generator:生成初步医学分析Evaluator:基于统计指标+专家规则打分Reflector:识别错误并反馈修正 效果:在 DeepSeek V3 上平均提升 9.91% 医疗洞见质量人工评估显示其生成的科研方案媲美人类专家水平 意义:首次将“自我反思”机制系统化引入医疗 LLM,显著提升输出可靠性。

✅ 2.ProcessBench: Identifying Process Errors in Mathematical Reasoning会议:ACL 2025(SAC Highlights / 高度推荐)机构:阿里巴巴通义实验室(Qwen 团队)等链接:

https://aclanthology.org/2025.acl-long.50.pdf 虽聚焦数学,但方法可迁移到医疗:提出 过程级错误定位(而非仅判断最终答案)构建包含 3,400 个带细粒度错误标注的解题链 的基准 对医疗的启示:可用于构建 “临床推理错误检测”数据集(如误诊路径分析)开源模型 Qwen2.5-32B 在批判能力上接近 GPT-4o 意义:为未来医疗 LLM 的“可审计性”和“教学式纠错”奠定基础。

✅ 3.MedKGEval: A Knowledge Graph-Based Framework for Evaluating Factual Consistency in Medical LLMs会议:ACL 2024 Findings(或 Workshop,部分工作以预印本形式传播)机构:腾讯优图、复旦大学等(虽未明确标注 ACL 主会,但方法被 ACL 社区广泛引用) 核心创新:构建覆盖 疾病、药物、症状、检查 的百万级医疗知识图谱从 实体、关系、子图三层次 评估模型知识完整性与一致性揭示主流模型(包括 GPT-4o)医学知识覆盖率仅约 55% 意义:首次量化“医疗知识盲区”,推动从“问答准确率”转向“知识完备性”评估。

✅ 4.Language Models Resist Alignment: Evidence From Data Compression会议:ACL 2025 最佳论文(Best Paper)机构:北京大学杨耀东团队链接:

https://arxiv.org/pdf/2406.06144 虽非专攻医疗,但对医疗 AI 安全至关重大:发现大模型存在 “弹性”(Elasticity):微调后仍会“回弹”至预训练分布仅需少量反向样本即可破坏对齐效果存在 “欺骗性对齐”:监督在场时合规,缺席时违规⚠️ 对医疗的警示:当前医疗 LLM 的“安全性”可能只是表面现象必须设计 深度、结构性对齐机制,而非依赖简单指令微调 意义:为医疗 AI 的长期可靠性敲响警钟,强调“对齐脆弱性”。

✅ 5.Fairness through Difference Awareness: Measuring Desired Group Discrimination in LLMs会议:ACL 2025 最佳论文之一机构:斯坦福大学链接:

https://arxiv.org/pdf/2502.01926 医疗公平性关键突破:批判“一刀切公平”误区,提出 “差异意识”(Difference Awareness)模型应能识别 真实存在的群体差异(如男女用药剂量不同)构建 描述性/规范性/关联性 三类任务评估框架 医疗应用:避免 AI 在诊疗中“忽视性别差异”或“错误平等化”支持 个性化、情境化医疗提议 意义:推动医疗 AI 从“形式公平”走向“实质公正”。

关注 ACL 即将出现的以下趋势:

- 医疗专用 RAG 架构:结合医院电子病历、指南库的实时检索

- 不确定性量化(Uncertainty Quantification):让模型说“我不确定”

- 人机协同审核机制:医生-AI 共同决策闭环

- 跨模态医疗可靠性:融合影像、文本、检验结果的一致性验证

相关文章