#探寻人工智能# #科普# #学习#

这两年,AI 圈最容易让人懵的,是黑话越来越密。

前脚还在讲 Token、Agent、Vibe Coding,

后脚又冒出来一个 MCP。

许多人第一反应都是:

这又是什么新模型?

还是又一个新平台?

或者又是程序员自嗨的缩写?

都不是。

MCP 不是新模型,也不是新 App。

它更像 AI 世界里的一种“通用接口标准”。

你目前如果不懂它,短期可能只是刷文章时有点懵;

但已经到了 2026 年,这种“不懂”会越来越明显:由于越来越多 AI 产品、AI 工具、AI 工作流,都会默认你知道 MCP 是什么。

这不是我在夸张。MCP 官方目前直接把它定义成一种开源标准,用来让 Openclaw、Hermes、Claude Code 这类 AI 应用连接外部系统,列如本地文件、数据库、搜索工具和各类工作流;官方还给了一个超级好懂的比喻:MCP 就像 AI 应用的 USB-C 接口。

如果你看到这里只记住一句话,那就记这一句:

MCP,本质上就是让 AI 更方便地“接工具、接数据、接能力”的统一插口。

一、MCP 到底是啥?

MCP,全称是 Model Context Protocol。

名字看起来很技术,翻译成人话实则不复杂:

它是一套规则,规定 AI 应用该怎么和外部世界对接。

以前,AI 想接一个工具,常常要每家单独适配。

接日历是一套方式,接 GitHub 又是一套方式,接数据库还是另一套方式。

不同平台、不同客户端、不同开发团队,各写各的接口。

结果就是:

AI 明明越来越机智,真正“干活”时却常常卡在“怎么接外部系统”这一步。

MCP 的意义,就是把这件事尽量统一起来。

Anthropic 在最早介绍 MCP 时说得很直白:它是一个开放标准,让开发者可以把自己的数据源和 AI 工具安全地双向连接起来;开发者可以做 MCP server,也可以做能连接这些 server 的客户端。

所以你可以把它理解成这样:

- 模型负责思考

- MCP负责连线

- 外部工具/数据负责提供真实能力

模型再机智,如果接不上外面的工具,它许多时候也只是“会说”;

一旦接上了,它才更像“会干活”。

二、为什么 2026 年 MCP 突然这么重大?

由于 AI 的重点,已经从“会不会回答”变成了“能不能做事”。

这点实则官方信号已经很明显了。

OpenAI 在 2025 年 5 月就宣布,Responses API 支持远程 MCP server,并明确说这是为了让开发者把模型接到任何 MCP server 上,只需要很少代码;同时 OpenAI 还加入了 MCP 的 steering committee。OpenAI 当时还直接点名了一批远程 MCP server 生态,列如 Cloudflare、HubSpot、PayPal、Shopify、Stripe、Twilio、Zapier 等,意思很明显:MCP 不再只是概念,而是在往真实业务接入走。

到了 2026 年,这个趋势更明显了。

MCP 官方在 2026 年 3 月 9 日 发布的 roadmap,直接把 2026 年的重点写成了四件事:

- transport scalability

- agent communication

- governance maturation

- enterprise readiness

翻译成人话就是:

它已经不只是“开发者玩具”,而是在朝着更大规模传输、更像 agent 之间通信、更成熟的治理、以及企业可用的方向推进。

这很关键。

由于一个协议一旦开始谈“企业就绪”“治理成熟”“可扩展”,就说明它已经不是边缘话题了,而是在进入主流基础设施阶段。

三、为什么说后来不懂 MCP,会越来越听不懂 AI 圈?

由于你后来看到的许多 AI 黑话,表面上在说插件、技能、工作流、代理,底层实则都在和 MCP 发生关系。

举个很直接的例子。

OpenAI 在 2026 年 3 月 25 日的 Codex 更新里提到,Codex 目前有插件目录,而这些插件可以把 skills、可选应用集成和 MCP server 配置 打包在一起。也就是说,后来别人跟你说“这个插件能一键装整套流程”,背后很可能就已经把 MCP 配进去了。

再列如 ChatGPT 的 Developer Mode 官方文档里,已经明确写了:你可以在设置里为远程 MCP server 创建 app,它之后会出目前会话里的 Developer Mode 工具中;支持的 MCP 协议包括 SSE 和 streaming HTTP,认证则支持 OAuth、无认证和混合认证。换句话说,MCP 已经不是停留在 PPT 上,而是开始进入实际产品入口。

GitHub 这边更典型。GitHub 官方文档把 MCP 定义成一种开放标准,用来让应用向大模型提供上下文;同时明确说 MCP 可以扩展 GitHub Copilot 的能力,而且 MCP 能跨 Copilot 的多个使用面工作,包括 IDE、Copilot CLI,以及 GitHub.com 上的 agent。

这意味着什么?

意味着你后来会越来越频繁看到这些话:

- 这个 agent 接了 MCP server

- 这个工作流能走远程 MCP

- 这个插件已经把 MCP 配好了

- 这个 Copilot 能直接调用某个 MCP 工具

- 这个项目支持 local MCP / remote MCP

如果你不懂 MCP,看到这些词时就会有一种熟悉的陌生感:

每个字都认识,连起来不知道在说什么。

四、MCP 到底解决了什么问题?

一句话:

它解决的是“AI 怎么标准化地接入外部能力”这个问题。

以前大家做 AI 工具,常常有个麻烦:

我想让 AI 访问 GitHub,得写一套。

我想让 AI 访问数据库,又得写一套。

我想让 AI 调企业内部系统,还得再写一套。

每接一个东西,都像重新装修一次接口。

而 MCP 想做的,是把“接线方式”尽量标准化。

官方文档里给的例子就很直观:

- agent 可以访问你的 Google Calendar 和 Notion,变成更个性化的助手

- Claude Code 可以根据 Figma 设计稿生成整个网页应用

- 企业聊天机器人可以同时连多个数据库,让用户用聊天方式分析数据

- AI 模型甚至可以去 Blender 里建模,再把设计送去 3D 打印

你会发现,这里面真正的重点已经不是“回答问题”,而是:

AI 正在从内容生成工具,变成任务执行入口。

而 MCP,就是这类入口背后的通用连接层。

五、你可以把 MCP 理解成“AI 的插线板”

许多人第一次看 MCP,会被“协议”“上下文”“server”这些词吓到。

实则你完全可以用一个土方法理解它:

没有 MCP 时

AI 像一台很机智但接口混乱的设备。

每接一个外设,都得单独买转接头。

有了 MCP 之后

AI 像一台开始统一接口的设备。

许多工具、服务、数据源,都可以按同一套方式接进来。

这就是为什么官方会用 “USB-C for AI applications” 这个比喻。

由于它强调的不是“某一个工具多强”,而是连接方式统一之后,整个生态会快许多。

你后来再听到别人说:

“这个 AI 目前能接 GitHub、接支付、接客服系统、接知识库、接工作流平台。”

许多时候,他真正想表达的,就是:

它已经不只是个聊天框了,它背后有一堆通过 MCP 接进来的能力。

六、MCP 里最容易听到的 5 个词,提前讲人话

1)MCP Server

这不是“服务器很高级”的意思。

它更像一个“能力出口”。

谁有数据、谁有工具、谁想把某种能力开放给 AI 用,谁就可以做一个 MCP server。

列如 GitHub 官方就做了 GitHub MCP Server。

它能让 AI 直接连到 GitHub 平台,去读仓库和代码文件、管理 issue 和 PR、分析代码、自动化工作流,全都可以用自然语言完成。

2)MCP Client

这个更像“会去调用这些能力的那一端”。

列如 Claude、ChatGPT、Copilot 这种 AI 应用,如果它能接 MCP server,它就相当于具备了“去外面拿工具和上下文”的能力。

3)Local MCP / Remote MCP

大白话就是:

- Local:本地跑

- Remote:远程调用

OpenAI 在 Developer Mode 文档里写得很明确,目前支持远程 MCP server,协议包括 SSE 和 streaming HTTP。

4)Tools

就是 AI 能调用的动作。

列如搜文件、查订单、开工单、建分支、合并 PR 这类。

5)Context

就是模型做事前需要知道的信息。

列如你是谁、你在什么项目里、当前代码库长什么样、数据库里有哪些表、企业文档在哪。

别小看这个词。

MCP 全名里就有 Context。

由于 AI 真正干活时,上下文往往比模型本身还更决定结果。

七、为什么说 MCP 不是程序员专属,而是所有 AI 用户都该懂一点?

由于你未必自己去写 MCP server,

但你很可能会越来越频繁地用到“已经接了 MCP 的 AI 产品”。

这就像你不必定自己写浏览器内核,

但你得知道网页、插件、登录、云同步大致是什么。

未来许多 AI 产品的差距:“谁能接更多真实能力”。

GitHub 官方文档已经很明确:MCP 能跨 IDE、CLI 和 GitHub.com 上的 agent 工作;同时还提供 MCP registry,方便找服务。

MCP 官方文档也写得很清楚:MCP 对开发者能降低构建和集成复杂度;对 AI 应用和 agent 来说,能接入一整个工具和数据生态;对终端用户来说,结果就是 AI 更有能力,也更能代表你去完成动作。

所以普通读者要懂 MCP,是由于你会越来越常遇到这种情况:

你以为自己在用一个“更机智”的 AI,

实则你真正用到的,是一个“接了更多工具和数据”的 AI。

八、2026 年最容易爆火的一类 AI 项目,许多都和 MCP 有关

这也是为什么目前懂 MCP,会明显更容易看懂 AI 赛道。

由于你会发现,许多热门方向实则都在往同一个地方汇合:

- agent

- coding assistant

- 企业知识库

- 工作流自动化

- 插件化 AI

- 多工具协作

- AI 办公入口

这些表面上看是不同赛道,

底层却都离不开一件事:

让模型接上外部世界。

而 MCP 正在变成这件事的标准答案之一。

官方 roadmap 里已经把“agent communication”和“enterprise readiness”写成 2026 年优先方向,这说明 MCP 讨论的范围,正在从“模型怎么接工具”,逐步走向“agent 怎么彼此协作、企业怎么安全落地”。

这也是为什么 2026 年你会越来越常看到有人不再单独吹某个模型,

而是开始吹:

- 这个 MCP server 很强

- 这个生态接了多少 MCP

- 这个工具能不能当 MCP server

- 这个客户端的 MCP 兼容怎么样

由于赛点已经开始变化了。

九、普通人最该记住的 3 句话

说了这么多,你不需要一下子学会技术细节。

先记住这 3 句就够了。

第一句:MCP 不是模型,是接口标准。

它不负责“变机智”,它负责“接能力”。

第二句:MCP 火起来,是由于 AI 开始从会说话,变成会做事。

越是要做真实任务,越离不开标准化连接外部工具和数据。

第三句:你不必定要会做 MCP,但最好要能听懂 MCP。

由于后来许多插件、agent、工作流、技能包、企业集成,都会默认你知道它。

十、最后一句大白话总结

如果说前两年 AI 圈最重大的词,是 Prompt、Agent、RAG,

那到了 2026,MCP 很可能会逐步变成新的“底层常识”。

它不像某个模型那样抢眼,

也不像某个爆款 App 那样容易上热搜。

但它很像一条正在铺的路。

路修好之后,许多车都会跑在上面;

你平时未必总盯着路看,

但你要是连这条路是什么都不知道,后面就会越来越听不懂大家在聊什么。

所以,为什么说 2026 年不懂 MCP,会越来越听不懂 AI 圈?

由于 AI 圈接下来讨论的重点,

很可能不再只是“谁更机智”,

而是:

谁接得更多、谁接得更稳、谁接得更标准。

而 MCP,正是这件事里越来越绕不过去的那个词。

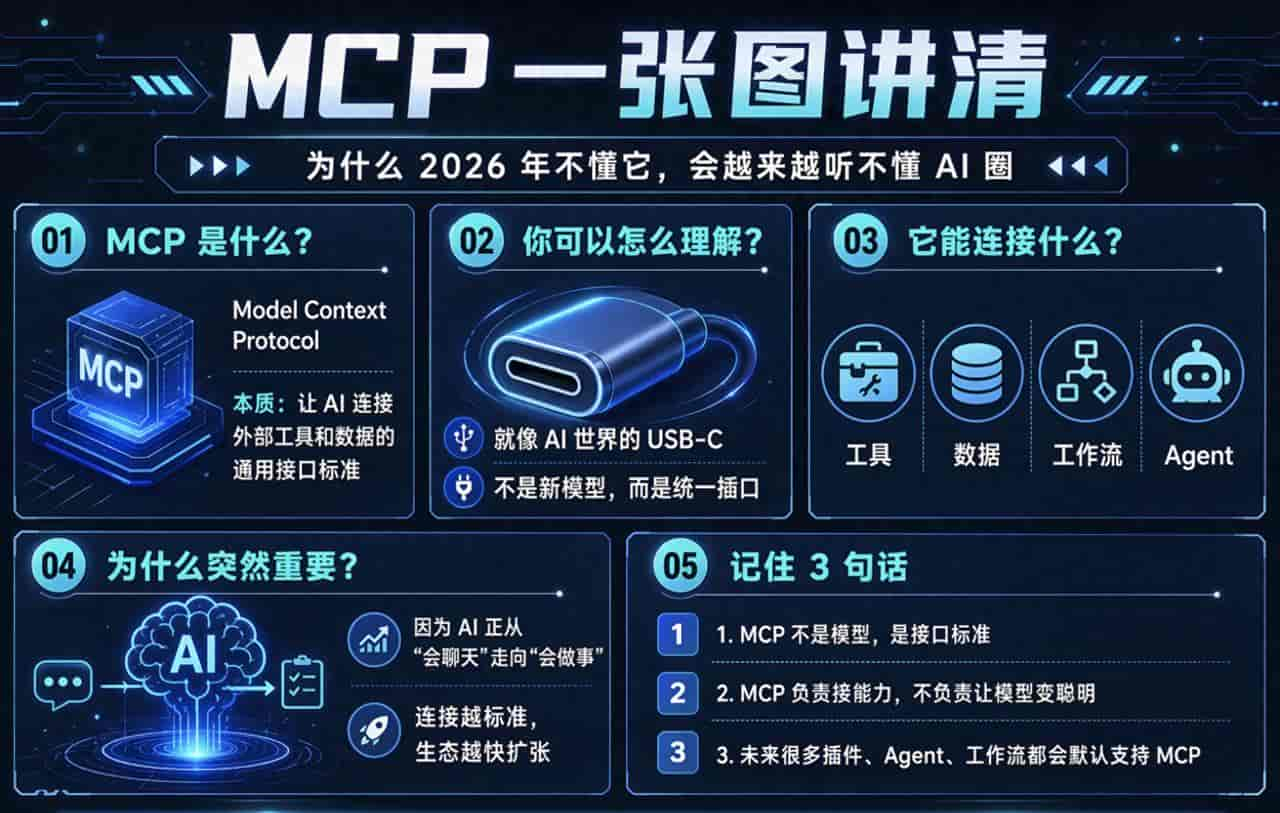

一图概要,点赞收藏

相关文章