Spring Boot整合Zookeeper分布式锁:原理、实战与避坑指南

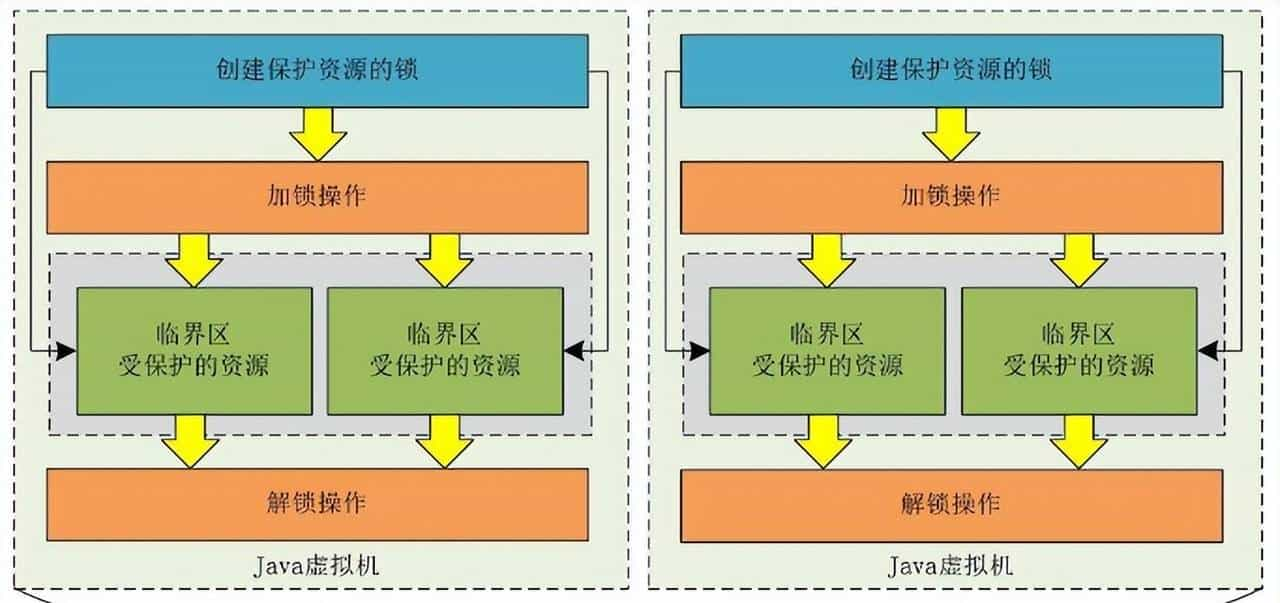

在分布式架构普及的今天,数据一致性成为互联网应用的核心诉求之一。当多个服务实例并发操作共享资源(如库存扣减、订单创建、缓存更新)时,单机环境下的synchronized或Lock机制已完全失效 —— 跨 JVM 进程的竞争无法通过本地锁解决,由此引发的超卖、数据脏读、重复提交等问题,可能直接导致业务损失。

分布式锁作为解决跨进程并发控制的关键技术,其核心目标是保证 “同一时刻只有一个进程 / 线程操作共享资源”。目前主流的分布式锁实现方案包括 Redis、Zookeeper、数据库乐观锁等,而 Zookeeper 凭借强一致性、崩溃自动恢复、天然支持分布式协调的特性,在高可靠性场景(如金融交易、核心业务流程)中占据不可替代的地位。

对于 Spring Boot 开发者而言,整合 Zookeeper 分布式锁不仅能解决实际业务痛点,更能加深对分布式协调原理的理解 —— 这也是中高级开发工程师必备的核心技能之一。

Zookeeper 分布式锁的底层逻辑

要掌握整合方案,第一需理解 Zookeeper 实现分布式锁的核心原理,其本质是基于临时有序节点 + Watcher 机制的协调逻辑:

Zookeeper 核心特性支撑

临时节点:客户端与 Zookeeper 建立会话后创建的节点,会话断开时节点自动删除(避免死锁);

有序节点:Zookeeper 会为同名节点自动分配递增序号(如lock-00000001),保证节点唯一性;

Watcher 机制:客户端可监听节点变化(如节点删除),触发回调逻辑(实现锁的释放与竞争)。

分布式锁核心流程(含公平锁实现)

锁竞争:客户端在 Zookeeper 的指定路径(如/distributed-lock)下创建临时有序子节点;

锁判断:客户端获取该路径下所有子节点,排序后判断自身创建的节点是否为序号最小的节点:

- 是:成功获取锁,执行业务逻辑;

- 否:监听前序节点(序号比自身小 1 的节点),进入等待状态;

锁释放:

- 业务执行完毕,客户端主动删除自身创建的节点;

- 若客户端崩溃(会话断开),临时节点自动删除;

锁唤醒:前序节点被删除后,Zookeeper 触发 Watcher 回调,唤醒等待中的后序节点,重复 “锁判断” 步骤。

Zookeeper vs Redis:选型关键对比

|

特性 |

Zookeeper 分布式锁 |

Redis 分布式锁(Redlock 算法) |

|

一致性 |

强一致性(CP),适合核心业务 |

最终一致性(AP),适合非核心业务 |

|

死锁风险 |

无(临时节点自动删除) |

低(需设置过期时间,可能出现锁超时) |

|

锁类型 |

天然支持公平锁 |

需额外实现公平锁逻辑 |

|

可用性 |

集群部署,可用性高(需至少 3 节点) |

集群部署,可用性高(主从切换可能丢锁) |

|

适用场景 |

金融交易、订单创建等强一致场景 |

库存扣减、缓存更新等高性能场景 |

Spring Boot 整合 Zookeeper 分布式锁

环境准备

- 开发环境:JDK 1.8+、Maven 3.6+、Spring Boot 2.7.x;

- Zookeeper 环境:本地单机(用于测试)或集群(生产环境,推荐 3 节点);

- 核心依赖:Curator(Apache 开源的 Zookeeper 客户端,简化分布式锁实现)。

项目搭建与配置

在pom.xml中添加 Curator 与 Spring Boot 整合依赖:

<!-- Spring Boot Web 基础依赖(可选,如果需要提供HTTP接口) -->

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-web</artifactId>

</dependency>

<!-- Spring Boot 对 Zookeeper 的官方支持 -->

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter</artifactId>

</dependency>

<!-- Spring Boot Zookeeper 集成 -->

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-data-zookeeper</artifactId>

</dependency>

<!-- Apache Curator - 高级Zookeeper客户端库 -->

<dependency>

<groupId>org.apache.curator</groupId>

<artifactId>curator-recipes</artifactId>

<version>${curator.version}</version>

</dependency>

<!-- 可选:Curator 测试框架 -->

<dependency>

<groupId>org.apache.curator</groupId>

<artifactId>curator-test</artifactId>

<version>${curator.version}</version>

<scope>test</scope>

</dependency>spring:

zookeeper:

connect-string: 127.0.0.1:2181 # Zookeeper服务器地址(单机模式)

# 集群示例: 192.168.1.101:2181,192.168.1.102:2181,192.168.1.103:2181

# 会话配置

session-timeout: 5000 # 会话超时时间(毫秒),默认一般为60000

connection-timeout: 3000 # 连接建立超时时间(毫秒)

# 可选高级配置

max-retries: 3 # 最大重试次数

base-sleep-time: 1000 # 重试间隔基准时间(毫秒)

max-sleep-time: 5000 # 最大重试间隔时间(毫秒)

# 安全配置(如果需要)

# user: admin

# password: password123初始化 Curator 客户端

创建 Zookeeper 配置类,注入 CuratorFramework 实例:

import org.apache.curator.framework.CuratorFramework;

import org.apache.curator.framework.CuratorFrameworkFactory;

import org.apache.curator.retry.ExponentialBackoffRetry;

import org.springframework.beans.factory.annotation.Value;

import org.springframework.context.annotation.Bean;

import org.springframework.context.annotation.Configuration;

@Configuration

public class ZookeeperConfig {

@Value("${spring.zookeeper.connect-string}")

private String connectString;

@Value("${spring.zookeeper.session-timeout}")

private int sessionTimeout;

@Value("${spring.zookeeper.connection-timeout}")

private int connectionTimeout;

@Bean(initMethod = "start") // 初始化时启动客户端

public CuratorFramework curatorFramework() {

// 重试策略:初始等待1秒,最多重试3次

ExponentialBackoffRetry retryPolicy = new ExponentialBackoffRetry(1000, 3);

return CuratorFrameworkFactory.builder()

.connectString(connectString)

.sessionTimeoutMs(sessionTimeout)

.connectionTimeoutMs(connectionTimeout)

.retryPolicy(retryPolicy)

.namespace("distributed-lock-demo") // 命名空间(隔离不同应用的锁)

.build();

}

}分布式锁核心实现(基于 Curator)

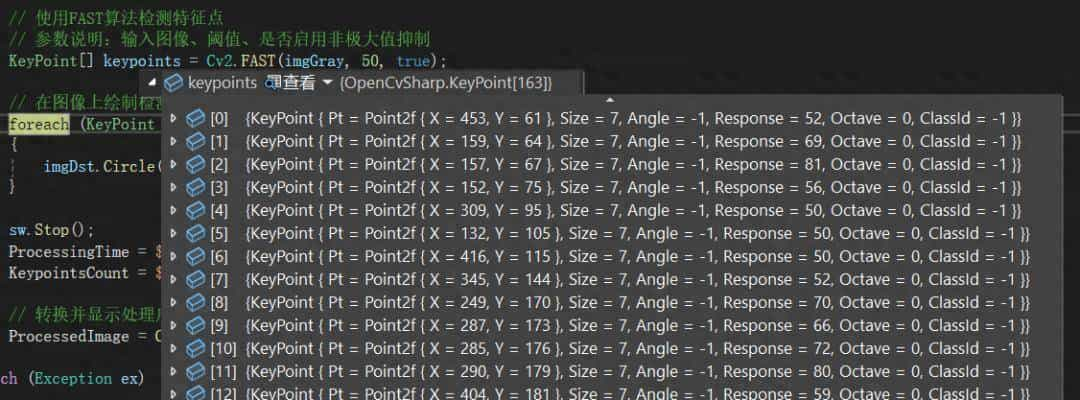

Curator 已封装 Zookeeper 分布式锁的底层逻辑,提供InterProcessMutex(可重入互斥锁)、InterProcessReadWriteLock(读写锁)等实现,我们以最常用的可重入互斥锁为例:

(1)封装分布式锁工具类

import org.apache.curator.framework.CuratorFramework;

import org.apache.curator.framework.recipes.locks.InterProcessMutex;

import org.springframework.beans.factory.annotation.Autowired;

import org.springframework.stereotype.Component;

import java.util.concurrent.TimeUnit;

@Component

public class ZookeeperDistributedLock {

@Autowired

private CuratorFramework curatorFramework;

// 锁路径前缀(实际锁路径为:/命名空间/lock-path/xxx)

private static final String LOCK_PREFIX = "/business-lock/";

/**

* 获取分布式锁

* @param lockKey 锁标识(如订单ID、商品ID)

* @param waitTime 等待时间(ms)

* @param leaseTime 锁持有时间(ms,超时自动释放)

* @return 锁实例(用于释放锁)

* @throws Exception 异常抛出(实际项目需统一处理)

*/

public InterProcessMutex acquireLock(String lockKey, long waitTime, long leaseTime) throws Exception {

String lockPath = LOCK_PREFIX + lockKey;

// 创建可重入互斥锁

InterProcessMutex lock = new InterProcessMutex(curatorFramework, lockPath);

// 尝试获取锁:等待waitTime,持有leaseTime后自动释放

boolean acquired = lock.acquire(waitTime, leaseTime, TimeUnit.MILLISECONDS);

if (!acquired) {

throw new RuntimeException("获取分布式锁失败,lockKey:" + lockKey);

}

return lock;

}

/**

* 释放分布式锁

* @param lock 锁实例

* @throws Exception 异常抛出

*/

public void releaseLock(InterProcessMutex lock) throws Exception {

if (lock != null && lock.isAcquiredInThisProcess()) {

lock.release(); // 释放锁(删除临时节点)

}

}

}(2)业务场景实战(以商品秒杀为例)

假设我们需要实现 “商品秒杀” 功能,需通过分布式锁防止超卖:

创建商品服务接口:

import org.springframework.stereotype.Service;

@Service

public class ProductService {

// 模拟商品库存(实际项目需从数据库查询)

private int stock = 100;

/**

* 秒杀减库存

* @param productId 商品ID

* @return 秒杀结果

*/

public String seckillProduct(String productId) {

if (stock return "商品已售罄!";

}

// 模拟减库存操作

stock--;

return "秒杀成功!剩余库存:" + stock;

}

}创建秒杀接口(整合分布式锁):

import org.apache.curator.framework.recipes.locks.InterProcessMutex;

import org.springframework.beans.factory.annotation.Autowired;

import org.springframework.web.bind.annotation.GetMapping;

import org.springframework.web.bind.annotation.PathVariable;

import org.springframework.web.bind.annotation.RestController;

@RestController

public class SeckillController {

@Autowired

private ProductService productService;

@Autowired

private ZookeeperDistributedLock distributedLock;

/**

* 秒杀接口(测试地址:http://localhost:8080/seckill/{productId})

* @param productId 商品ID

* @return 秒杀结果

*/

@GetMapping("/seckill/{productId}")

public String seckill(@PathVariable String productId) {

InterProcessMutex lock = null;

try {

// 1. 获取分布式锁:等待3秒,持有5秒(防止服务崩溃导致锁无法释放)

lock = distributedLock.acquireLock(productId, 3000, 5000);

// 2. 执行秒杀业务(加锁后确保同一商品同一时刻只有一个请求执行)

return productService.seckillProduct(productId);

} catch (Exception e) {

return "秒杀失败:" + e.getMessage();

} finally {

// 3. 释放锁(必须在finally中执行,确保锁必定会释放)

try {

if (lock != null) {

distributedLock.releaseLock(lock);

}

} catch (Exception e) {

e.printStackTrace();

}

}

}

}测试验证(模拟高并发场景)

可使用 Postman、JMeter 等工具模拟多线程并发请求:

- 测试地址:http://localhost:8080/seckill/PROD_001(商品 ID 为 PROD_001);

- 并发数:100 线程(模拟 100 人同时秒杀);

- 预期结果:库存从 100 减至 0,无超卖(库存不会出现负数),无重复扣减。

避坑指南与最佳实践

1. 核心避坑点

坑点 1:锁路径设计不合理导致锁竞争激烈

- 问题:所有业务共用一个锁路径(如/lock),导致无关业务相互阻塞;

- 解决方案:按业务模块 + 资源标识设计锁路径(如/order-lock/{orderId}、/stock-lock/{productId}),缩小锁粒度。

坑点 2:未设置锁持有时间导致死锁

- 问题:客户端获取锁后崩溃,未主动释放锁(虽临时节点会随会话断开删除,但会话超时可能需分钟级);

- 解决方案:通过leaseTime设置锁持有时间(如 5 秒),超时自动释放,结合业务实际耗时调整。

坑点 3:Watcher 机制滥用导致 “惊群效应”

- 问题:所有等待锁的客户端监听同一个节点,导致节点删除时大量客户端同时竞争锁;

- 解决方案:使用 Curator 的InterProcessMutex(已优化为监听前序节点,而非所有节点),避免惊群效应。

坑点 4:Zookeeper 集群不可用导致服务雪崩

- 问题:Zookeeper 集群故障时,分布式锁无法获取,导致业务阻塞;

- 解决方案:

- 对锁操作添加超时降级(如获取锁超时后返回 “系统繁忙,请重试”);

- 生产环境部署 Zookeeper 集群(至少 3 节点),确保高可用。

2. 最佳实践

锁粒度最小化:仅对共享资源的操作加锁,避免大面积代码块加锁(影响性能);

避免长事务加锁:锁持有时间应尽量短,避免在锁内执行数据库慢查询、远程调用等耗时操作;

异常处理与监控:对锁的获取 / 释放过程添加日志(如 “获取锁成功”“释放锁失败”),结合 Prometheus+Grafana 监控锁竞争情况;

结合业务场景选型:非核心业务(如缓存更新)可选用 Redis 锁(性能更高),核心业务(如订单支付)优先选用 Zookeeper 锁(强一致性)。

总结

Spring Boot 整合 Zookeeper 分布式锁的核心是借助 Curator 客户端简化底层实现,开发者无需关注 Zookeeper 节点创建、Watcher 监听等细节,只需聚焦业务逻辑与锁的合理使用。

通过本文的原理剖析与实战案例,信任大家已掌握分布式锁的核心逻辑与整合步骤 —— 关键在于理解 “临时有序节点 + Watcher” 的协调机制,同时规避锁粒度、死锁、集群可用性等常见问题。

在实际项目中,提议结合业务场景选择合适的分布式锁方案,并通过压测验证锁的性能与可靠性。如果需要进一步优化(如实现读写锁、分布式计数器)或扩展其他场景(如分布式屏障、选主),可基于 Curator 的其他工具类进行开发。

相关文章