1 简介

- GitHub主页:https://github.com/fredericksalazar/OllamaFX

OllamaFX 是一个基于 JavaFX 开发的原生桌面客户端,旨在为 Ollama 提供直观且先进的交互层,让模型管理与对话在优化且优雅的环境中高效实现。该项目的核心愿景,是打造一款兼具聊天交互功能与本地模型全生命周期管理能力的一站式工具。

2 使用 OllamaFX 的理由

2.1 降低交互门槛,告别命令行繁琐操作

原生 Ollama 的核心操作依赖 命令行界面(CLI),存在较高使用门槛:

- 所有操作需记忆固定指令(如拉取模型 ollama pull <模型名>、运行模型 ollama run <模型名>、查看本地模型 ollama list、删除模型 ollama rm <模型名> 等),对非技术用户不友善,甚至技术用户频繁操作也会显繁琐;

- 命令行交互为纯文本形式,无排版、无可视化反馈,对话过程中无法便捷编辑、回溯上下文,使用体验较为粗糙。

而 OllamaFX 提供 图形化桌面界面(GUI),所有操作均可通过点击、拖拽、下拉选择等可视化方式完成:无需记忆任何指令,即可实现模型拉取、运行、管理、会话切换等全流程操作,大幅降低使用门槛,同时提供美观的文本排版、明暗主题切换,提升交互舒服度。

2.2 补齐模型管理短板,实现智能高效管控

原生 Ollama 仅提供最基础的模型管理能力,无法满足精细化、智能化需求:

- 无硬件适配判断:用户无法提前知晓某个模型是否适配自己的电脑配置(如显存、内存是否足够),盲目拉取或运行模型可能导致系统卡顿、崩溃;

- 无社区趋势洞察:用户只能手动输入已知模型名进行拉取,无法快速发现社区热门模型、高性价比模型;

- 本地库管理简陋:仅能列出本地模型,无智能缓存、分类筛选、快速检索等功能,本地模型较多时难以高效管控。

OllamaFX 凭借「硬件智能适配」和「高级模型探索器」,完美解决这些问题:

- 自动分析硬件规格,通过颜色编码可视化标识模型适配程度,提前规避硬件不兼容风险;

- 内置社区趋势模块,实时呈现热门模型,方便用户发现优质模型;

- 支持本地模型智能缓存、快速检索与分类管理,实现模型即时加载,提升本地库管控效率。

2.3 优化会话管理,支撑多任务并行协作

原生 Ollama 的会话管理能力极其薄弱,无法满足多任务处理场景:

- 单一会话限制:同一时间仅能运行一个模型会话,若需切换任务(如同时用 A 模型写代码、B 模型润色文案),需关闭当前会话、重新启动新模型,操作繁琐;

- 上下文易丢失:命令行会话关闭后,对话历史与上下文会完全丢失,无法后续回溯、继续对话;

- 无会话归类管理:无法对不同任务、不同模型的会话进行命名、归类,长期使用后难以追溯历史对话。

OllamaFX 的「基于会话的工作流」针对性解决这些痛点:

- 多会话并行:支持同时开启多个不同模型的独立会话,无需关闭当前会话即可切换任务;

- 上下文持久化:自动保存所有会话的历史记录与上下文逻辑,一键切换即可继续之前的对话;

- 会话有序管理:可对会话进行命名、归类,方便后续快速检索与回溯,提升多任务协作效率。

2.4 优化资源与使用体验,专注核心任务

原生 Ollama 无额外的体验优化设计,容易分散用户注意力或造成资源浪费:

- 资源分配不智能:原生 Ollama 仅负责运行模型,不做资源优先级优化,可能出现客户端占用过多资源,导致模型运行效率下降的情况;

- 无专业化使用环境:命令行界面无干扰屏蔽能力,无法提供专注于对话与模型管理的无干扰环境。

OllamaFX 则通过「原生高效架构」实现优化:

- 轻量化设计:优先保障模型运行所需的硬件资源,自身仅占用极少系统资源,确保模型处理效率最大化;

- 无干扰专业化界面:屏蔽无关信息干扰,支持明暗主题切换,适配不同使用场景(如夜间办公、专业研发),让用户可专注于模型交互与任务处理。

3 特性与优势

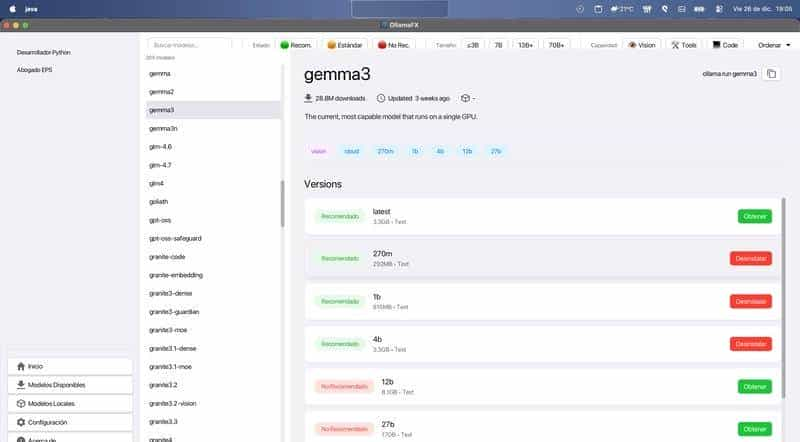

3.1 硬件智能适配

作为核心创新点,OllamaFX 可深度分析系统硬件规格,基于模型运行可行性对库中模型进行智能分类:

- 视觉化适配标识:通过资源可用性关联的颜色编码系统,提前预判模型与当前配置的适配程度;

- 安全操作保障:在任务与模型匹配过程中,最大限度降低操作摩擦,同时保障系统运行稳定性。

集成硬件智能

3.2 原生高效架构

依托 JavaFX 与 AtlantaFX 的技术优势,构建现代化、简洁且高性能的用户界面:

- 轻量化设计:优化资源占用,确保计算机核心算力聚焦服务于模型处理;

- 专业化界面:提供无干扰交互环境,全面支持明暗主题切换,适配不同使用场景。

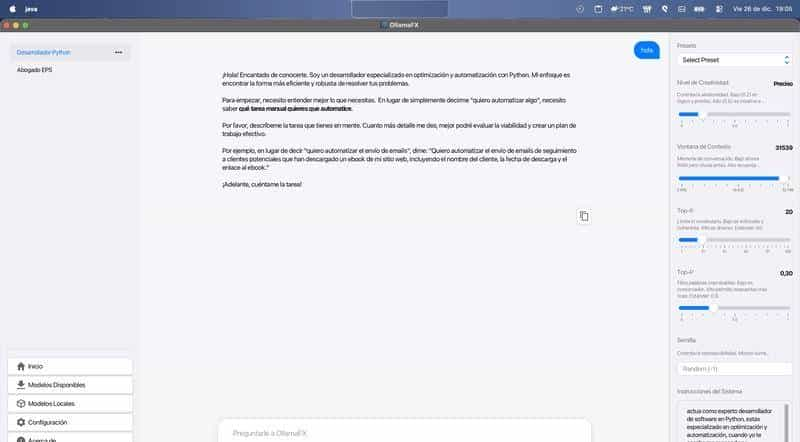

3.3 多会话工作流

v0.4.0 版本新增专为多任务场景设计的侧边栏功能:

- 多情境并行管理:支持同时开启多个不同模型的独立会话;

- 无缝切换体验:一键切换聊天会话,完整保留各对话的历史记录与上下文逻辑。

基于会话的工作流

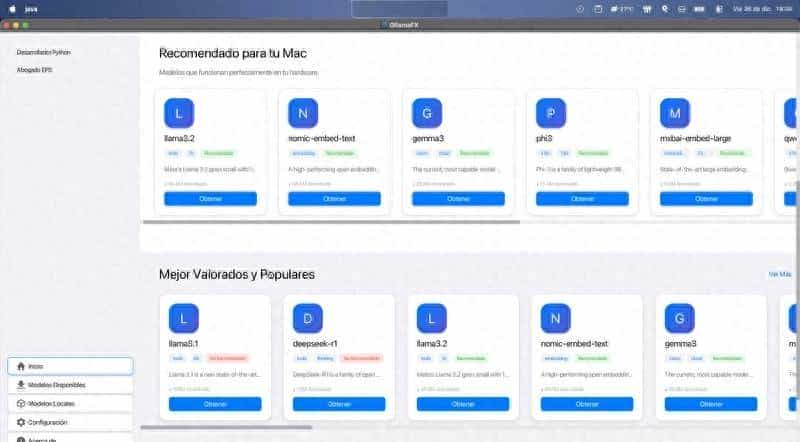

3.4 高级模型探索器

全新设计的首页模块,让模型发现与下载更高效:

- 社区趋势洞察:实时呈现热门模型、社区高关注度选型;

- 本地库智能管理:通过智能缓存机制实现模型即时加载,高效管控本地模型资源。

高级模型探索器

3.5 开源社区驱动

OllamaFX 基于 MIT 协议开源,免费、透明且开放协作。项目愿景是构建开发者生态,推动本地人工智能技术持续升级。

4 小结

简单来说:

- 原生 Ollama 是「幕后引擎」,负责模型的下载、运行等底层支撑,但操作繁琐、功能简陋;

- OllamaFX 是「前台智能操作台」,基于 Ollama 引擎封装了更友善、更高效、更智能的可视化功能,让普通用户也能轻松驾驭本地 LLM,让专业用户的工作效率大幅提升。

如果没有 OllamaFX,本地 Ollama 的使用价值会因门槛高、效率低而大打折扣;而 OllamaFX 的存在,能充分释放 Ollama 的本地模型能力,实现「1+1>2」的使用效果。

使用教程有没有?给大家分享一下?下载了用不了

收藏了,感谢分享