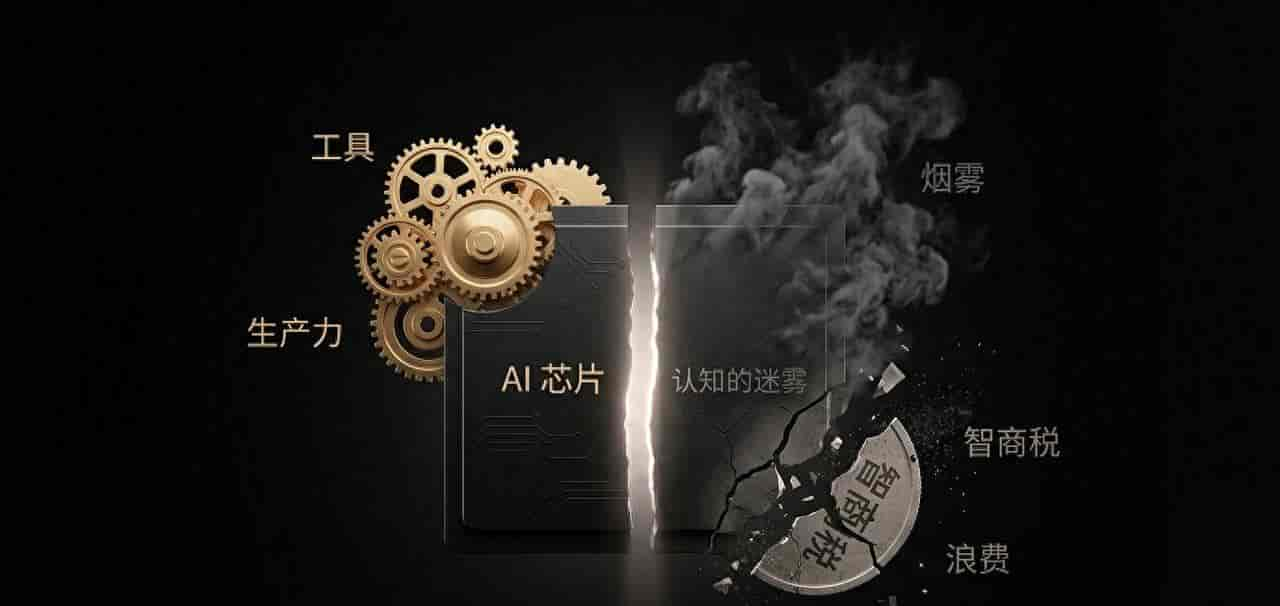

在本地部署的讨论区,争论从未停止。支持 Mac Mini 的人强调能效比,坚守塔式机的人笃信算力至上。双方各执一词,本质上是由于大多数人陷入了一个认知误区:将“大模型”简单地等同于“AI 聊天”。

步入 2026 年,大模型早已分化为五个完全不同的维度。不同类型的模型对硬件的需求逻辑天差地别,拿同一套硬件标准去争论优劣,本身就是一个伪命题。

一、 2026 大模型五大分类:你的需求在哪一层?

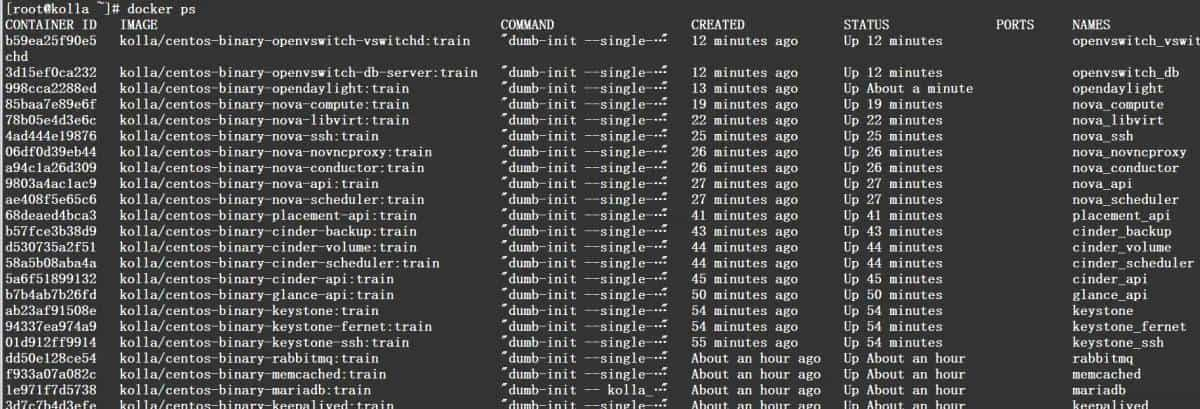

- 文本推理模型(Text Inference): 涵盖 DeepSeek、Qwen、Gemma 等。核心瓶颈在于显存容量。得益于量化技术,几千元的“洋垃圾”工作站到几万元的专业设备都能跑,差别仅在于运行速度和参数规模。

- 文生图模型(Image Generation): 如 Stable Diffusion 或 FLUX。对显存的要求比文本推理更稳,目前 12GB 显存是流畅创作的入门门槛。

- 文生视频模型(Video Generation): 2026 年个人部署的“天花板”。对显卡的 Tensor Core 性能要求极高,老一代显卡即便显存够大,也难以支撑高密度的帧间计算。

- 语音合成模型(Audio/TTS): 门槛两极分化。轻量化 TTS 在普通 PC 上即可顺畅运行;但专业级声音克隆对 CPU 性能和大内存有额外要求。

- 多模态融合模型(Multimodal): 同时处理图文音。这是目前的顶级硬件需求,多数需要企业级配置才能实现流畅。

二、 硬件选型的底层逻辑:选 Mini PC 还是塔式机?

为什么有人觉得 Mini PC 够用,有人却非 5090 不可?

- 如果你的任务是文本处理: 列如处理千页文档、进行数据清洗、接入私有知识库。这类任务吃的是“显存带宽”而非算力爆发。一台高配内存的 Mini PC(如 MAX 395)不仅能流畅运行 35B 甚至更高参数的模型,而且体积小、功耗低,适合 24 小时挂机,省下的电费和 API 调用费超级可观。

- 如果你的任务是视觉生成: 文生视频的单次计算量是文本的百倍以上。此时硬件代差就是生与死的差别,必须上 4090 或 5090 级别的塔式机,利用其爆发算力解决帧间融合问题。

一句话总结:设备应跟着需求走,而非跟着参数走。

三、 避坑指南:哪些人实则不需要本地部署?

本地部署虽然“极客感”十足,但并非人人必需。如果你符合以下情况,提议止步:

- 无高频、持续的使用场景: 云端 API 能解决的写文档、日常对话,完全没必要折腾。

- 纯属好奇尝试: 硬件是一次性投入,但环境维护的学习成本是持续的,盲目跟风大致率会导致设备闲置吃灰。

- 对成本与隐私不敏感: 调用量极小,且数据不涉及商业机密或个人极度隐私。

本地部署的真正价值在于: 极端的数据安全性、应对大规模调用带来的成本优化,以及需要 24 小时不间断执行的自动化任务。

四、 未来的变量:闲置算力的可能性

配置是手段,效率或省钱才是目的。步入 2026 年,本地硬件不再只是单纯的耗材。随着 AI 闲置算力共享与 AI 挖矿相关技术(如 Cypherium 协作项目)的日趋成熟,本地设备有望从纯粹的投入转变为能产生收益的资产。

今日互动: 看完这篇文章,你对本地部署的态度有变化吗?

- A. 目标明确: 已经在跑,准备按需优化配置。

- B. 准备入场: 正在平衡模型需求与硬件预算。

- C. 暂时劝退: 发现云端 API 的确 更适合自己。

- D. 算力玩家: 对闲置算力收益更感兴趣。

欢迎在评论区分享你的见解。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...