硅谷初创公司Luma AI推出全新图像模型Uni-1,弃用主流扩散模型转向自回归架构,实现图像理解与生成的统一,这一技术换道或将改写AI图像生成的行业规则。

从视频工具到图像模型,Luma的跨界破局

创立于2021年的Luma AI,此前因视频生成工具Dream Machine在业内积累了知名度。此次推出Uni-1,标志着这家仅150人的初创公司,正式从单一视频赛道切入AI图像生成领域,瞄准行业核心痛点发起冲击。

不同于其他玩家在现有技术框架内修修补补,Luma AI选择了一条更具颠覆性的路线:抛弃统治AI图像生成领域三年的扩散模型,采用大语言模型同款的自回归架构,让图像模型像理解语言一样理解视觉需求。

这种底层架构的换道,本质上是对AI图像生成逻辑的重构——从“降噪出图”的机械流程,转向“推理创作”的智能过程,这也是Uni-1最核心的竞争力所在。

自回归架构如何让AI学会“思考画图”

当前主流的扩散模型,核心逻辑是从随机噪声出发,在文本提示的引导下逐步降噪生成图像。这种方式能产出视觉效果不错的画面,但存在天生缺陷:模型无法理解图像背后的空间关系、物理逻辑和语义约束,只能被动执行指令。

为了弥补这一缺陷,行业玩家一般采用“打补丁”的方式,列如让大语言模型先优化提示词,再交给图像模型生成。但这种“外挂式”的推理,本质上是在两个独立模型之间增加翻译层,无法从根本上解决理解偏差问题。

Uni-1则采用纯解码器自回归Transformer架构,将文本和图像token放入同一序列中处理,让模型在生成图像的全过程中进行结构化推理:从分解用户指令、解决逻辑约束,到规划画面构图,每一步都像人类创作一样有思考过程。

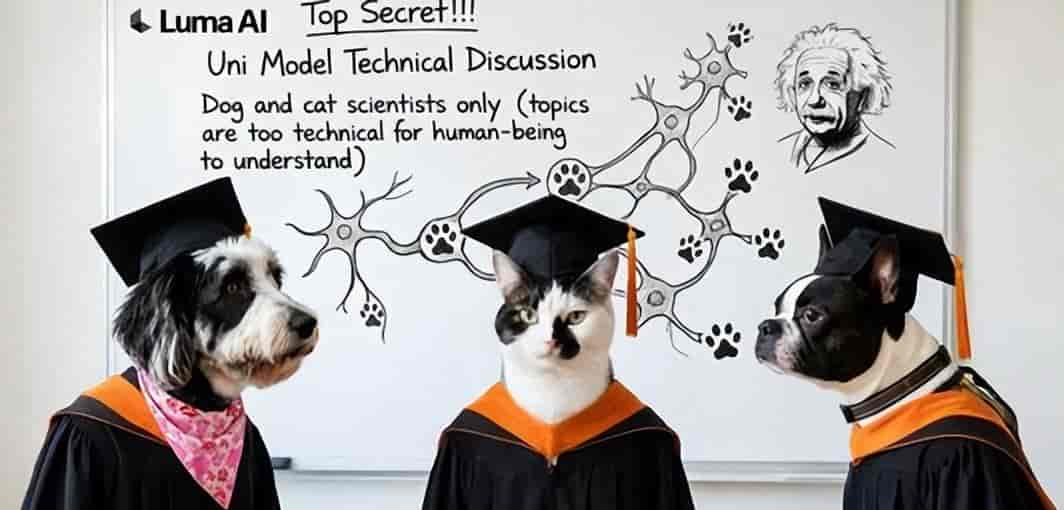

列如用户要求把多张宠物照片合成到学术场景中,Uni-1能自动保留每只宠物的独特特征,合理安排它们在画面中的位置,甚至给它们穿上合身的学术礼服——这些任务以往需要大量手动调整或后期处理。

跑分与体验:推理能力的全面突破

在RISEBench推理基准测试中,Uni-1综合得分0.51,略高于谷歌Nano Banana 2的0.50,在空间推理维度更是以0.58的得分大幅领先竞品。尤其值得关注的是,Uni-1的逻辑推理得分达到0.32,是OpenAI GPT Image 1.5的两倍以上。

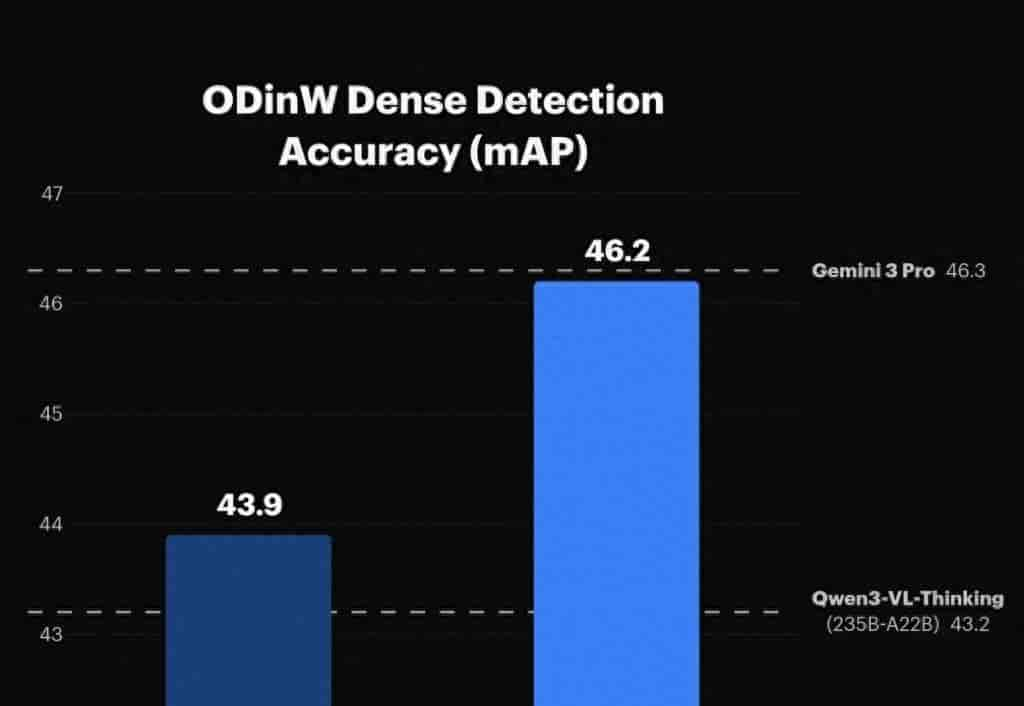

在物体检测基准测试ODinW-13中,Uni-1完整版得分46.2 mAP,几乎追平谷歌Gemini 3 Pro的46.3。更有意思的是,仅具备理解能力的Uni-1变体得分43.9,而经过生成训练的完整版得分提升了2.3分,这直接证明:学会生成图像能反过来提升模型的图像理解能力。

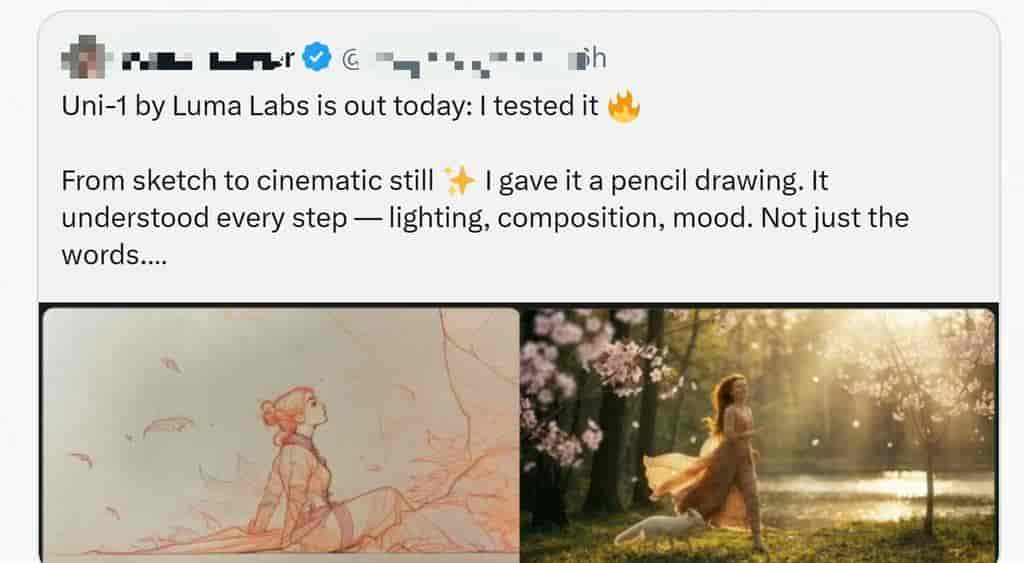

智东西的实际体验也验证了这一点:输入“生成一张宿命感照片,一个长发飘飘的女子身穿战国袍配剑”的提示词后,Uni-1会先花几秒钟分析需求,再开始创作。最终生成的画面细节丰富、语义精准,头发和衣摆的动态自然,服饰质感十足,仅在剑的数量上出现小误差。

社区反馈同样积极,有用户评价称,Uni-1让图像生成终于告别了“提示词碰运气”的阶段,实现了真正的创作控制。不过也有用户指出,Uni-1在生成速度、非拉丁文字处理等方面仍有优化空间。

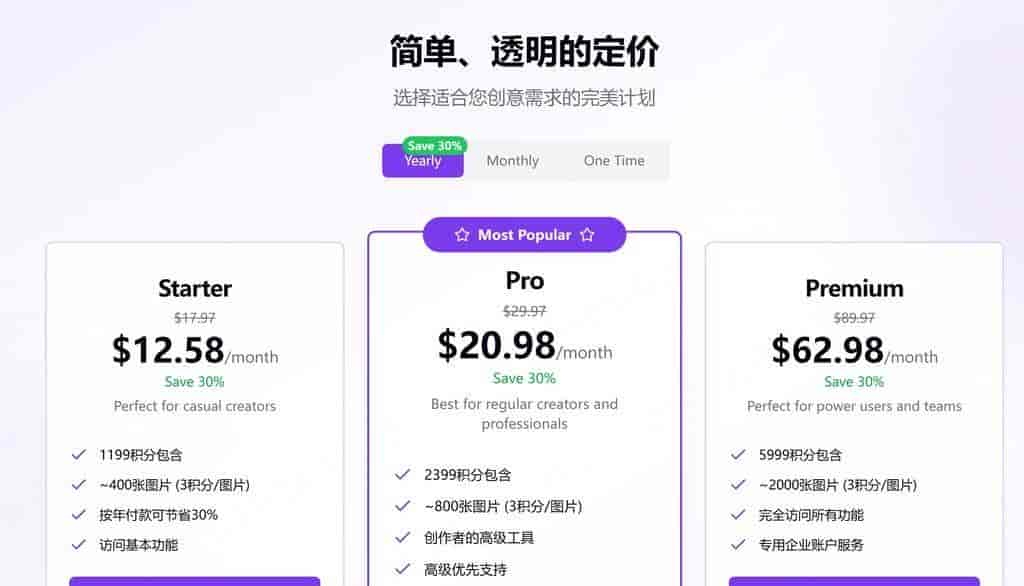

定价与市场:以性价比撬动企业客户

在定价策略上,Uni-1主打“性能更强、价格更低”的差异化竞争。针对企业客户常用的2K分辨率图像生成,Uni-1的成本比谷歌Nano Banana 2低10%-30%,对于大规模生产高分辨率图像的团队来说,这一成本优势极具吸引力。

面向个人用户,Uni-1提供包年、包月和单次计价三种模式,同时开放免费体验通道。作为初创公司,Luma AI无法在分发渠道和基础设施上与谷歌、OpenAI等巨头抗衡,性能与成本的双重优势,是它打动客户的核心筹码。

目前Uni-1的API访问正在逐步开放,Luma AI显然希望通过企业级场景的验证,进一步巩固技术优势,在巨头林立的AI图像生成市场占据一席之地。

技术换道的行业意义与未来挑战

Uni-1的发布,标志着AI图像生成的竞争从“拼视觉效果”转向“拼理解能力”。自回归架构首次在核心基准测试上证明了其可行性,这不仅为行业提供了新的技术方向,也可能影响更多实验室的研发路线选择。

不过,Luma AI面临的挑战也不容忽视:第一是大规模API调用的稳定性和速度,企业级客户对生成效率的要求远高于个人用户;其次是多语言支持和边缘场景的适配能力,这决定了Uni-1的市场覆盖范围;最后是与现有工作流的集成能力,能否无缝融入设计师、内容创作者的日常工作,将直接影响其商业化进程。

从更宏观的角度看,Uni-1的探索也为通用人工智能的发展提供了思路:当图像模型能像语言模型一样推理,跨模态的智能融合或许会比我们想象的更快到来。这场AI图像生成领域的架构之争,才刚刚进入正赛。

#人工智能##图像生成##大语言模型##扩散模型##Gemini#

相关文章