一、AI圈炸了!布鲁纳大模型携芯片黑科技来袭

AI行业再传颠覆性消息,备受关注的布鲁纳大模型(LLM Bruner)即将正式上线,更令人震撼的是,其配套专用芯片直接将通义千问(Qwen)大模型烧录到芯片硅体中,无需额外加载模型权重,本地推理速度直接拉满,每秒可处理10000个代币,彻底打破本地大模型运行的速度瓶颈。

要知道,当前普通用户本地运行大模型,要么依赖高端显卡投入高额成本,要么忍受每秒几十、几百个代币的卡顿速度,隐私泄露风险也时刻存在。布鲁纳大模型这套“芯片+模型”的组合,看似完美解决了所有痛点,但它真的能改写本地AI的格局吗?背后又藏着哪些不为人知的局限?

二、核心拆解:一文读懂布鲁纳大模型的芯片黑科技

1. 产品核心定位

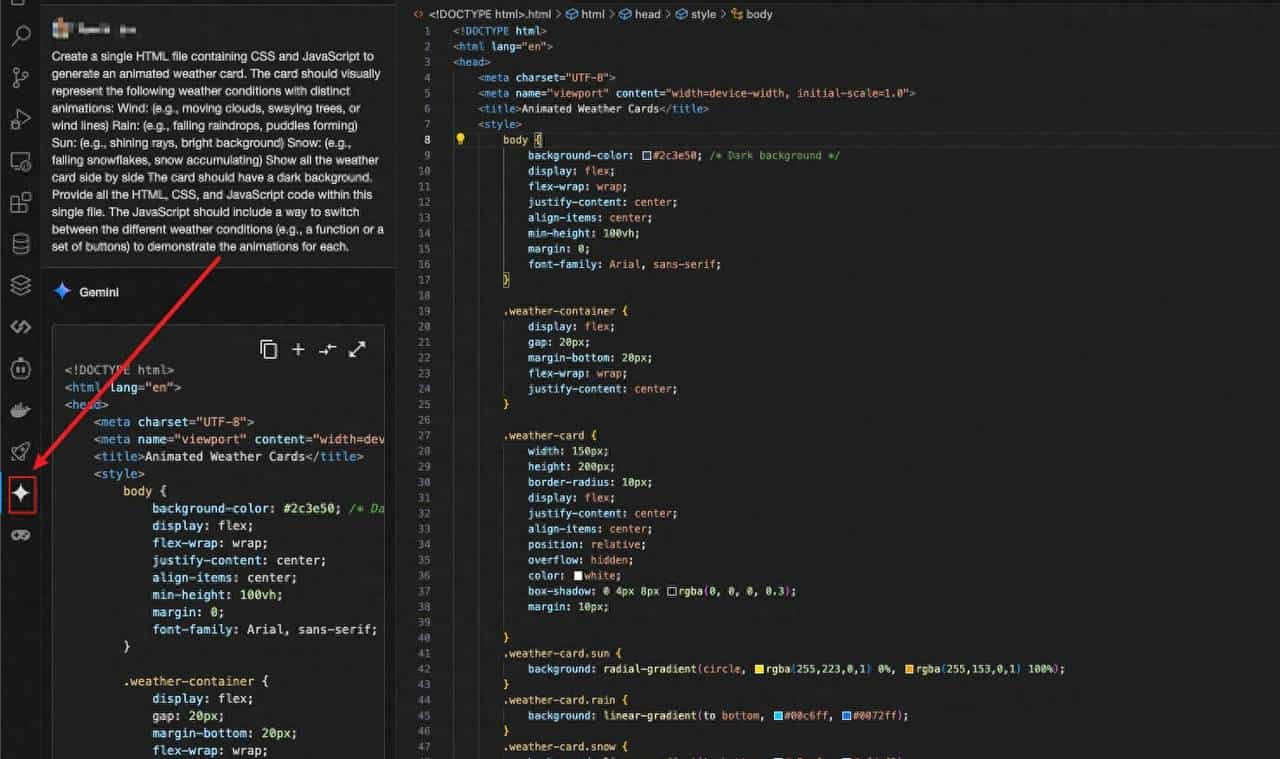

布鲁纳大模型是一款即将推出的中等尺寸大模型,其最大亮点并非模型本身的参数优势,而是配套的专用硬件方案——由Taalos团队研发的PCIe接口ASIC芯片,这款芯片最大的突破的是,将通义千问系列中等尺寸大模型(重点是Qwen 3.5-27B)直接烧录固化,实现“芯片即模型”的全新形态。

2. 芯片烧录核心原理

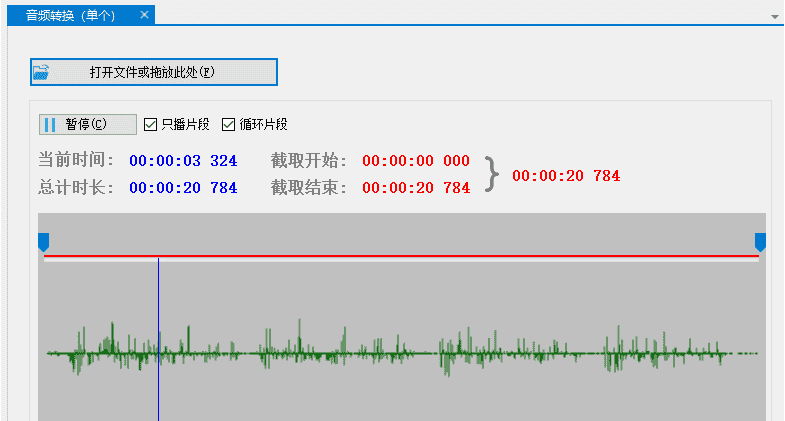

许多人误以为芯片烧录是“用火烧制”,实则不然,它的核心是通过特定电压和时序,将通义千问的二进制程序代码永久写入芯片内部的存储单元,就像在“电子画布”上精准雕刻图案,每个存储单元对应一个代码位,最终实现模型与芯片的深度融合,从硬件底层完成部署,无需后续加载权重文件。整个烧录过程需经过连接核对、擦除旧数据、精准编程、校验核对、安全加密五个关键步骤,确保模型烧录的稳定性和安全性。

3. 核心性能实测

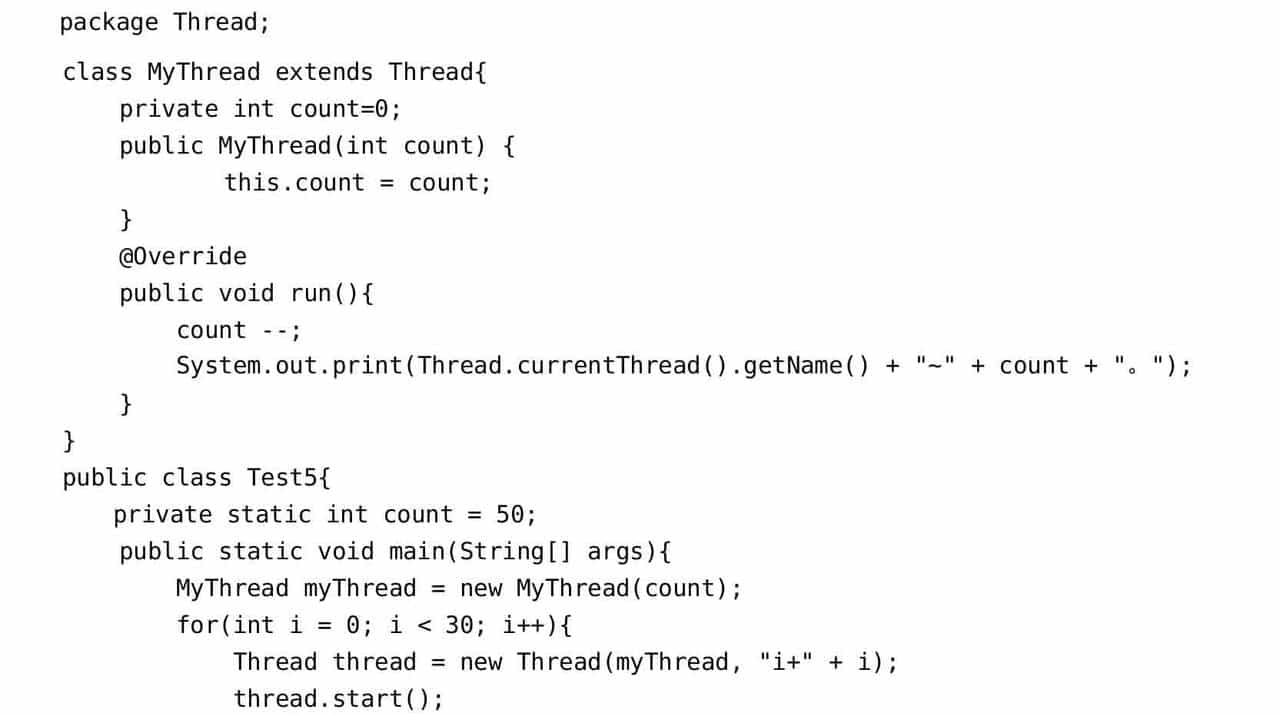

- 代币处理速度:本地运行时,每秒可稳定处理10000个代币,而小参数模型(如Llama 3.1 8B)搭配该芯片,速度更是突破17000个代币/秒,远超当前主流GPU推理速度——要知道,普通GPU运行大模型,推理速度一般只有每秒几十个代币,即便高端GPU也难以突破千级大关。

- 硬件适配要求:采用标准PCIe接口,属于普通电脑可直接安装的扩展卡,无需搭建复杂的显卡集群,家用台式机、普通办公电脑均可适配,门槛极低。

- 功耗控制表现:功耗仅为传统显卡运行方案的十分之一,实现超低功耗运行,既节省电费,也无需额外配备散热设备,兼顾实用性和经济性。

- 上线时间节点:Taalos研发团队明确表明,2026年春季将推出实验室级产品,距离正式落地已进入倒计时阶段。

4. 产品定价定位

不同于以往专用AI芯片动辄上万元的定价,这款布鲁纳大模型配套ASIC芯片,面向普通消费级市场,定价亲民,让个人用户、中小开发者无需投入高额成本,就能体验到每秒万级代币的本地推理速度,真正实现高端AI技术的平民化。

三、辩证分析:黑科技背后,机遇与局限并存

不可否认,布鲁纳大模型这套“模型烧录芯片”的方案,是本地AI推理领域的一次重大突破。它彻底解决了普通用户本地运行大模型的三大痛点:无需高端显卡降低硬件门槛,每秒万级代币解决速度卡顿,模型烧录本地运行杜绝隐私泄露,同时超低功耗也契合当下绿色科技的发展趋势,为大模型硬件化落地提供了全新路径。

但冷静下来分析,这项技术的局限也同样明显。第一,模型直接烧录到芯片中,意味着模型无法灵活更新迭代——一旦通义千问推出新版本,或者布鲁纳大模型本身升级,已购买的芯片将无法适配,相当于“买一次就落后”,后期使用成本隐性增加。其次,专用ASIC芯片的通用性极差,仅能适配布鲁纳大模型和指定的通义千问型号,无法兼容其他主流大模型,用户若想使用其他模型,仍需额外配备显卡,灵活性大打折扣。最后,目前公布的仅为实验室级产品计划,实际量产难度、量产后的稳定性、长期使用的故障率,以及后期的技术支持,都还存在诸多不确定性,能否真正落地普及仍是未知数。

对于用户而言,这是一场“速度与灵活”的取舍;对于行业而言,这是“专用硬件与通用硬件”的博弈,布鲁纳大模型的出现,究竟是行业进步的缩影,还是昙花一现的概念创新,仍需时间检验。

四、现实意义:重构本地AI生态,惠及普通用户与开发者

对于普通AI爱好者和个人用户来说,布鲁纳大模型配套芯片的出现,彻底打破了“高端AI只能依赖云端或高端显卡”的困境。无需花费大价钱购买高端显卡,无需忍受卡顿的推理速度,也无需担心云端使用的隐私泄露问题,在家用电脑上就能流畅运行大模型,无论是日常AI对话、文案生成,还是简单的代码辅助,都能实现“秒级响应”,真正让AI走进普通人的生活。

对于开发者而言,这套方案提供了大模型硬件化的全新思路,推动中等尺寸大模型从“软件部署”向“硬件固化”转型,不仅降低了本地AI应用的开发门槛,也为通义千问等国产大模型的落地提供了新的载体,加速本地AI应用的普及,让国产大模型与专用硬件的结合,拥有了更广阔的发展空间。

长远来看,若布鲁纳大模型及其配套芯片能顺利量产落地,将彻底改变本地大模型的使用格局,推动AI从“云端依赖”向“本地普及”转型,实现隐私、速度、成本三者的平衡,甚至可能引发AI硬件领域的新一轮变革,带动更多专用AI芯片的研发与落地。

五、互动话题:你会为布鲁纳大模型的芯片黑科技买单吗?

- 每秒10000个代币的本地速度,能否打动你放弃传统显卡方案?

- 模型无法更新的局限,会成为你拒绝这款芯片的核心缘由吗?

- 你认为“模型烧录芯片”会成为未来本地大模型的主流形态吗?

欢迎在评论区留下你的见解,一起探讨布鲁纳大模型带来的AI行业新变化,聊聊本地AI的未来发展方向。

相关文章