大规模工程提速:打造亚百毫秒级 (Sub-100ms) API 的架构实战

在高并发系统中,如何将 API 响应时间稳定在 100 毫秒以内?本文深入解析了异步扇出、多级缓存、熔断降级等核心模式,并指出:架构决定速度,但文化决定持久。

高性能系统并非建立在微观优化之上,而是建立在一系列深思熟虑的、分层的决策之上,这些决策旨在最小化不确定性并控制尾部延迟 (Tail Latency)。本文将拆解高吞吐量系统中使用的实际模式、权衡和护栏。

异步扇出:无痛并行 (Async Fan-Out)

慢 API 一般归结为一个根本缘由:串行依赖。

如果你的系统执行三个下游调用,每个耗时 40ms,那么你还没做任何实际业务逻辑就已经损失了 120ms。

并行扇出

Java 的 CompletableFuture 是天然的选择,特别是搭配为下游并发调整过的**自定义执行器 (Custom Executor)**:

ExecutorService pool = new ThreadPoolExecutor(

20, 40, 60, TimeUnit.SECONDS,

new LinkedBlockingQueue<>(500),

new ThreadPoolExecutor.CallerRunsPolicy()

);

CompletableFuture<UserProfile> profileFuture =

CompletableFuture.supplyAsync(() -> profileClient.getProfile(userId), pool);

CompletableFuture<List<Recommendation>> recsFuture =

CompletableFuture.supplyAsync(() -> recClient.getRecs(userId), pool);

CompletableFuture<OrderSummary> orderFuture =

CompletableFuture.supplyAsync(() -> orderClient.getOrders(userId), pool);

return CompletableFuture.allOf(profileFuture, recsFuture, orderFuture)

.thenApply(v -> new HomeResponse(

profileFuture.join(),

recsFuture.join(),

orderFuture.join()

));

但大多数文章没提到的警告是:异步代码不会消除阻塞——它只是将其隐藏在线程池中。

如果执行器配置错误,可能会引发:

- CPU 抖动 (Thrashing)

- 线程争用

- 队列积压

- 内存溢出 (OOM)

- 整个集群的级联减速

线程池经验法则:对于下游 IO 密集型调用,线程池大小应为 2 × CPU核心数 × 每个请求的预期并行下游调用数(并通过 p95/p99 负载测试进行调整)。

多级缓存:快路径的艺术

快速系统不会消除工作——它们避免重复做昂贵的工作。一个典型的层级结构:

- 本地缓存 (Caffeine) – 亚毫秒级

- Redis 缓存 – 3–5 ms

- 数据库 – 20–60+ ms

采用双级缓存模式。在此示例中,Redis 使用 10 分钟 TTL,而本地内存缓存的时间应更短(一般为 1 分钟),否则它很容易变成“永久缓存”,导致实例间数据不一致。

public ProductInfo getProductInfo(String productId) {

ProductInfo local = localCache.getIfPresent(productId);

if (local != null) return local; // 快路径

ProductInfo redisValue = redis.get(productId);

if (redisValue != null) {

localCache.put(productId, redisValue);

return redisValue;

}

ProductInfo dbValue = db.fetch(productId); // 慢路径(冷路径)

redis.set(productId, dbValue, Duration.ofMinutes(10));

localCache.put(productId, dbValue);

return dbValue;

}

缓存失效:计算机科学中最难的问题

低延迟系统严重依赖缓存,但没有清晰失效策略的缓存就像一颗定时炸弹。

失效方式 优点 缺点 1. 基于时间 (TTL) 简单、安全、广泛使用 TTL 越长,陈旧数据风险越高 2. 基于事件 生产者发送“失效”事件 需要强数据所有权 3. 基于版本 缓存 Key 包含版本号 (product:v2:123) 旧数据变得不可达

数据分类是关键:

- Public(商品标题):随意缓存。

- Internal(内部ID):带护栏缓存。

- Confidential(PII):加密且严格 TTL。

- Restricted(PCI):永不缓存。

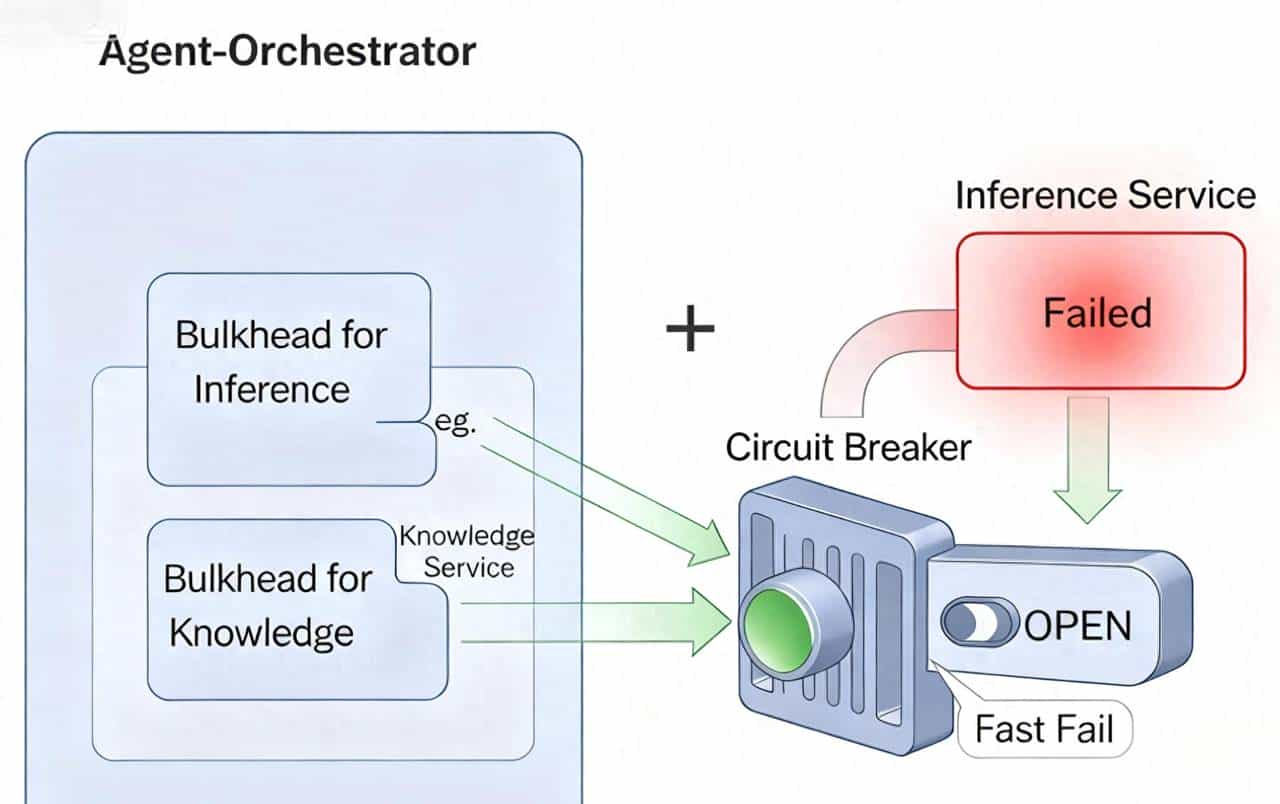

熔断器:别让慢依赖感染你的尾部延迟

依赖项不需要完全宕机才会惹麻烦——持续的高延迟就足够了。

熔断器 (Circuit Breaker) 作为你的服务与不稳定依赖之间的边界。当错误或超时超过阈值时,熔断器打开,暂时停止发送流量。这让系统从“等待并堆积”转变为“快速失败并降级”。

CircuitBreakerConfig config = CircuitBreakerConfig.custom()

.failureRateThreshold(50)

.slidingWindowSize(20)

.waitDurationInOpenState(Duration.ofSeconds(5))

.build();

Supplier<List<Recommendation>> supplier =

CircuitBreaker.decorateSupplier(cb, () -> recClient.getRecs(userId));

try {

return supplier.get();

} catch (Exception ex) {

return Collections.emptyList(); // 快速降级

}

降级 (Fallbacks):”快而残缺” 胜过 “慢而完美”

降级的目的不是假装什么都没发生,而是阻止下游的缓慢吞噬你的延迟预算。

降级策略应该是:

- 提供有用的东西(如缓存快照、默认值)。

- 可预测地快。

- 不产生额外负载。

public ProductPageResponse getPage(String productId) {

try {

return fetchFullPage(productId);

} catch (TimeoutException e) {

return fetchCachedSnapshot(productId); // 热、最小化、安全

}

}

可观测性:让速度可度量

最大的误解是:一旦你达到了低延迟,工作就结束了。真相恰恰相反:如果不积极守护,速度会衰退。

关注 p99 而非平均值

- p50: 典型用户

- p95: 稍微倒霉的用户

- p99: 如果这种情况常常发生就会放弃你产品的客户

如果你的 p50 是 45ms 但 p99 是 320ms,你的系统并不快——它只是有时快。

分布式追踪:低延迟系统的吐真剂

指标 (Metrics) 告知你某件事花了多长时间。追踪 (Tracing) 告知你为什么。 通过 OpenTelemetry + Jaeger,你可以发现诸如“Redis 每小时有一次尖峰”或“线程池饥饿”等仪表盘无法揭示的问题。

SLO 与 燃烧率告警 (Burn-Rate Alerts)

一个典型的 SLO:p95 < 120ms。 燃烧率告警是 SLO 原生的早期预警系统。如果燃烧率 > 14.4(意味着预算将在 2 天内耗尽),即刻触发告警。这让团队能在问题波及所有用户之前进行回滚或修复。

总结:架构是蓝图,文化是引擎

大规模工程提速的终极一课: 架构可以让你的系统变快。文化让它保持快速。

那些像关注正确性一样关注 p99、设计时思考延迟预算、并从回退中学习的团队,才是能够持续交付如丝般顺滑体验的团队。持续的低延迟不是运气,而是跨越时间、团队和技术的微小而自律的决策的结果。

笔者锐评 ️

这篇文章是后端架构领域的“实战圣经”。作者没有空谈理论,而是直接给出了 Java 代码示例和具体的参数提议(如线程池大小计算公式),超级硬核。

特别是关于“异步代码只是把阻塞藏进了线程池”的警告,简直是振聋发聩。多少次生产事故,都是由于滥用 CompletableFuture 却没配置好独立的 Executor 导致的。

此外,文中提到的“文化决定性能”也是至理名言。在业务压力下,性能往往是第一个被牺牲的指标。只有建立起“性能回归即事故”的工程文化,才能守住那 100ms 的生死线。

求点赞 求关注 ❤️ 求收藏 ⭐️ 你的支持是我更新的最大动力!

相关文章