语言模型推理能力的领域知识依赖度分析

关键词:语言模型、推理能力、领域知识依赖度、自然语言处理、知识图谱、机器学习

摘要:本文旨在深入分析语言模型推理能力的领域知识依赖度。通过对语言模型的核心概念、推理算法原理、数学模型等方面进行详细阐述,结合项目实战案例,探讨领域知识对语言模型推理能力的影响。同时,分析了语言模型在不同实际应用场景中的表现,推荐了相关的学习资源、开发工具和研究论文。最后,总结了语言模型推理能力在领域知识依赖方面的未来发展趋势与挑战,并对常见问题进行了解答。

1. 背景介绍

1.1 目的和范围

语言模型在自然语言处理领域取得了显著进展,其推理能力是衡量模型性能的重要指标之一。然而,语言模型的推理能力往往受到领域知识的影响。本研究的目的在于系统地分析语言模型推理能力的领域知识依赖度,明确领域知识在推理过程中的作用和影响程度。研究范围涵盖了常见的语言模型架构,如基于Transformer的模型(如BERT、GPT系列),以及不同领域的知识表示和应用场景,包括医疗、金融、法律等领域。

1.2 预期读者

本文预期读者包括自然语言处理领域的研究人员、开发者、数据科学家,以及对语言模型技术感兴趣的学者和从业者。对于希望深入了解语言模型推理机制、提高模型在特定领域应用效果的读者,本文将提供有价值的参考。

1.3 文档结构概述

本文首先介绍了与语言模型推理能力和领域知识相关的核心概念及其联系,包括语言模型的基本原理和领域知识的表示方法。接着详细阐述了核心算法原理和具体操作步骤,并通过Python代码进行说明。然后介绍了相关的数学模型和公式,并结合实际例子进行讲解。在项目实战部分,给出了代码实际案例和详细解释。之后分析了语言模型推理能力在不同实际应用场景中的表现。推荐了学习语言模型和领域知识相关的工具和资源。最后总结了未来发展趋势与挑战,解答了常见问题,并提供了扩展阅读和参考资料。

1.4 术语表

1.4.1 核心术语定义

语言模型:一种用于计算文本序列概率分布的模型,能够根据输入的文本生成下一个可能的词或字符。常见的语言模型有基于统计的n-gram模型和基于深度学习的神经网络模型。推理能力:语言模型根据输入信息进行逻辑推导、得出结论的能力。推理可以是简单的语义理解,也可以是复杂的逻辑推理和问题解决。领域知识:特定领域内的专业知识和信息,如医学领域的疾病诊断知识、金融领域的投资策略知识等。领域知识通常以结构化(如知识图谱)或非结构化(如专业文献)的形式存在。领域知识依赖度:指语言模型的推理能力对领域知识的依赖程度,即领域知识在模型推理过程中所起的作用大小。

1.4.2 相关概念解释

自然语言处理(NLP):研究如何让计算机理解和处理人类语言的学科,语言模型是NLP中的重要工具。知识图谱:一种以图的形式表示知识的方法,节点表示实体,边表示实体之间的关系。知识图谱可以为语言模型提供结构化的领域知识。预训练模型:在大规模无监督数据上进行预训练的语言模型,如BERT、GPT等。预训练模型可以学习到通用的语言知识,但在特定领域的推理能力可能需要结合领域知识进行增强。

1.4.3 缩略词列表

NLP:Natural Language Processing(自然语言处理)BERT:Bidirectional Encoder Representations from Transformers(基于Transformer的双向编码器表示)GPT:Generative Pretrained Transformer(生成式预训练Transformer)RNN:Recurrent Neural Network(循环神经网络)LSTM:Long Short-Term Memory(长短期记忆网络)GRU:Gated Recurrent Unit(门控循环单元)

2. 核心概念与联系

语言模型的基本原理

语言模型的目标是对给定的文本序列 x=(x1,x2,⋯ ,xn)x = (x_1, x_2, cdots, x_n)x=(x1,x2,⋯,xn) 计算其概率 P(x)P(x)P(x)。常见的语言模型架构有基于RNN及其变体(如LSTM、GRU)和基于Transformer的模型。

基于RNN的语言模型通过循环结构依次处理输入序列中的每个词,利用隐藏状态来保存历史信息。例如,在时间步 ttt,RNN的隐藏状态 hth_tht 可以通过以下公式计算:

基于Transformer的语言模型则采用了自注意力机制,能够并行处理输入序列,捕捉长距离依赖关系。Transformer的核心组件是多头自注意力层,其计算过程如下:

输入序列 xxx 经过嵌入层得到词嵌入表示 XXX。对于每个头 iii,计算查询 QiQ_iQi、键 KiK_iKi 和值 ViV_iVi:

结构化表示:知识图谱是一种典型的结构化领域知识表示方法。知识图谱由实体、属性和关系组成,例如在医学知识图谱中,实体可以是疾病、药物、症状等,关系可以是“治疗”、“引发”等。知识图谱可以用图的形式表示,方便语言模型进行知识查询和推理。非结构化表示:专业文献、报告等文本数据是非结构化领域知识的主要来源。可以通过文本挖掘和信息抽取技术从这些文本中提取有用的知识,如关键词、实体关系等。

语言模型推理能力与领域知识的联系

语言模型的推理能力在很大程度上依赖于其对领域知识的掌握。通用语言模型在预训练阶段学习到的是广泛的语言知识,但在处理特定领域的推理任务时,可能由于缺乏领域知识而表现不佳。例如,在医疗领域的问答任务中,如果语言模型没有关于疾病诊断和治疗的专业知识,就很难给出准确的回答。

为了提高语言模型在特定领域的推理能力,可以将领域知识融入到模型中。一种方法是使用知识图谱来丰富模型的输入,另一种方法是在领域数据上进行微调。通过结合领域知识,语言模型可以更好地理解输入问题的语义,进行更准确的推理。

文本示意图

语言模型推理能力

|

|-- 通用语言知识

|-- 领域知识

|-- 结构化知识(知识图谱)

|-- 非结构化知识(专业文献)

Mermaid流程图

3. 核心算法原理 & 具体操作步骤

基于知识图谱增强的语言模型推理算法

算法原理

该算法的核心思想是将知识图谱中的领域知识融入到语言模型的推理过程中。具体来说,在输入文本时,首先从知识图谱中查找与输入相关的知识,然后将这些知识与输入文本一起作为语言模型的输入。

Python代码实现

import torch

from transformers import AutoTokenizer, AutoModelForQuestionAnswering

import rdflib

# 加载预训练的语言模型和分词器

tokenizer = AutoTokenizer.from_pretrained("bert-large-uncased-whole-word-masking-finetuned-squad")

model = AutoModelForQuestionAnswering.from_pretrained("bert-large-uncased-whole-word-masking-finetuned-squad")

# 加载知识图谱

g = rdflib.Graph()

g.parse("medical_knowledge_graph.ttl", format="turtle")

def get_related_knowledge(question, knowledge_graph):

# 简单示例:查找与问题中实体相关的三元组

entities = []

# 这里可以使用实体识别技术提取问题中的实体

# 为了简化,假设手动提取了实体

entities = ["disease1", "drug1"]

related_triples = []

for entity in entities:

for s, p, o in knowledge_graph.triples((None, None, rdflib.URIRef(entity))):

related_triples.append((s, p, o))

for s, p, o in knowledge_graph.triples((rdflib.URIRef(entity), None, None)):

related_triples.append((s, p, o))

knowledge_text = ""

for triple in related_triples:

knowledge_text += f"{triple[0]} {triple[1]} {triple[2]}. "

return knowledge_text

def answer_question(question):

# 获取相关知识

knowledge = get_related_knowledge(question, g)

# 拼接问题和知识

input_text = f"Knowledge: {knowledge} Question: {question}"

# 分词

inputs = tokenizer(input_text, return_tensors="pt")

# 模型推理

outputs = model(**inputs)

answer_start_scores = outputs.start_logits

answer_end_scores = outputs.end_logits

answer_start = torch.argmax(answer_start_scores)

answer_end = torch.argmax(answer_end_scores) + 1

answer = tokenizer.convert_tokens_to_string(tokenizer.convert_ids_to_tokens(inputs["input_ids"][0][answer_start:answer_end]))

return answer

# 示例问题

question = "What drug can treat disease1?"

answer = answer_question(question)

print(f"Question: {question}")

print(f"Answer: {answer}")

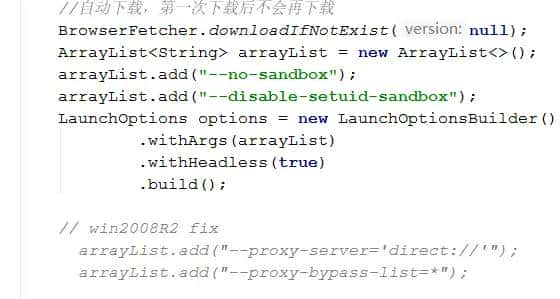

具体操作步骤

加载预训练的语言模型和分词器:使用Hugging Face的

transformers

rdflib

4. 数学模型和公式 & 详细讲解 & 举例说明

语言模型的概率计算

语言模型的目标是计算文本序列 x=(x1,x2,⋯ ,xn)x = (x_1, x_2, cdots, x_n)x=(x1,x2,⋯,xn) 的概率 P(x)P(x)P(x)。根据链式法则,P(x)P(x)P(x) 可以表示为:

在实际应用中,为了简化计算,通常使用近似方法。例如,n-gram模型假设每个词的概率只依赖于其前 n−1n – 1n−1 个词,即:

注意力机制的数学原理

在Transformer的多头自注意力机制中,注意力分数的计算如下:

QKTdkfrac{QK^T}{sqrt{d_k}}dkQKT 计算了查询和键之间的相似度,除以 dksqrt{d_k}dk 是为了防止点积结果过大,导致softmax函数的梯度消失。

softmax ext{softmax}softmax 函数将相似度分数转换为概率分布,用于对值矩阵进行加权求和。

举例说明

假设输入序列为 x=[“I”,”love”,”natural”,”language”,”processing”]x = [“I”, “love”, “natural”, “language”, “processing”]x=[“I”,”love”,”natural”,”language”,”processing”],词嵌入维度为 d=64d = 64d=64,头的数量为 h=8h = 8h=8,查询、键和值的维度为 dk=dv=8d_k = d_v = 8dk=dv=8。

计算查询、键和值:

对于每个头 iii,计算 Qi=XWiQQ_i = XW_i^QQi=XWiQ,Ki=XWiKK_i = XW_i^KKi=XWiK,Vi=XWiVV_i = XW_i^VVi=XWiV,其中 XXX 是输入序列的词嵌入矩阵,WiQW_i^QWiQ、WiKW_i^KWiK 和 WiVW_i^VWiV 是可学习的权重矩阵。计算注意力分数:

对于每个头 iii,计算 Attentioni(Qi,Ki,Vi)=softmax(QiKiTdk)Vi ext{Attention}_i(Q_i, K_i, V_i)= ext{softmax}(frac{Q_iK_i^T}{sqrt{d_k}})V_iAttentioni(Qi,Ki,Vi)=softmax(dkQiKiT)Vi。拼接所有头的输出:

将所有头的输出拼接起来,得到 Concat(Attention1,⋯ ,Attentionh)Concat( ext{Attention}_1, cdots, ext{Attention}_h)Concat(Attention1,⋯,Attentionh)。线性变换:

对拼接后的结果进行线性变换,得到最终的输出 MultiHead(Q,K,V)=Concat(Attention1,⋯ ,Attentionh)WOMultiHead(Q, K, V)=Concat( ext{Attention}_1, cdots, ext{Attention}_h)W^OMultiHead(Q,K,V)=Concat(Attention1,⋯,Attentionh)WO,其中 WOW^OWO 是输出权重矩阵。

5. 项目实战:代码实际案例和详细解释说明

5.1 开发环境搭建

安装Python和相关库

首先,确保你已经安装了Python 3.6或更高版本。然后,使用

pip

pip install transformers rdflib torch

transformers

rdflib

torch

transformers

torch

准备知识图谱数据

你需要准备一个知识图谱文件,例如

medical_knowledge_graph.ttl

5.2 源代码详细实现和代码解读

import torch

from transformers import AutoTokenizer, AutoModelForQuestionAnswering

import rdflib

# 加载预训练的语言模型和分词器

tokenizer = AutoTokenizer.from_pretrained("bert-large-uncased-whole-word-masking-finetuned-squad")

model = AutoModelForQuestionAnswering.from_pretrained("bert-large-uncased-whole-word-masking-finetuned-squad")

# 加载知识图谱

g = rdflib.Graph()

g.parse("medical_knowledge_graph.ttl", format="turtle")

def get_related_knowledge(question, knowledge_graph):

# 简单示例:查找与问题中实体相关的三元组

entities = []

# 这里可以使用实体识别技术提取问题中的实体

# 为了简化,假设手动提取了实体

entities = ["disease1", "drug1"]

related_triples = []

for entity in entities:

for s, p, o in knowledge_graph.triples((None, None, rdflib.URIRef(entity))):

related_triples.append((s, p, o))

for s, p, o in knowledge_graph.triples((rdflib.URIRef(entity), None, None)):

related_triples.append((s, p, o))

knowledge_text = ""

for triple in related_triples:

knowledge_text += f"{triple[0]} {triple[1]} {triple[2]}. "

return knowledge_text

def answer_question(question):

# 获取相关知识

knowledge = get_related_knowledge(question, g)

# 拼接问题和知识

input_text = f"Knowledge: {knowledge} Question: {question}"

# 分词

inputs = tokenizer(input_text, return_tensors="pt")

# 模型推理

outputs = model(**inputs)

answer_start_scores = outputs.start_logits

answer_end_scores = outputs.end_logits

answer_start = torch.argmax(answer_start_scores)

answer_end = torch.argmax(answer_end_scores) + 1

answer = tokenizer.convert_tokens_to_string(tokenizer.convert_ids_to_tokens(inputs["input_ids"][0][answer_start:answer_end]))

return answer

# 示例问题

question = "What drug can treat disease1?"

answer = answer_question(question)

print(f"Question: {question}")

print(f"Answer: {answer}")

代码解读

加载预训练模型和分词器:

tokenizer = AutoTokenizer.from_pretrained("bert-large-uncased-whole-word-masking-finetuned-squad")

model = AutoModelForQuestionAnswering.from_pretrained("bert-large-uncased-whole-word-masking-finetuned-squad")

使用

transformers

加载知识图谱:

g = rdflib.Graph()

g.parse("medical_knowledge_graph.ttl", format="turtle")

使用

rdflib

获取相关知识:

def get_related_knowledge(question, knowledge_graph):

# 简单示例:查找与问题中实体相关的三元组

entities = []

# 这里可以使用实体识别技术提取问题中的实体

# 为了简化,假设手动提取了实体

entities = ["disease1", "drug1"]

related_triples = []

for entity in entities:

for s, p, o in knowledge_graph.triples((None, None, rdflib.URIRef(entity))):

related_triples.append((s, p, o))

for s, p, o in knowledge_graph.triples((rdflib.URIRef(entity), None, None)):

related_triples.append((s, p, o))

knowledge_text = ""

for triple in related_triples:

knowledge_text += f"{triple[0]} {triple[1]} {triple[2]}. "

return knowledge_text

该函数从知识图谱中查找与问题中实体相关的三元组,并将其转换为文本形式。

回答问题:

def answer_question(question):

# 获取相关知识

knowledge = get_related_knowledge(question, g)

# 拼接问题和知识

input_text = f"Knowledge: {knowledge} Question: {question}"

# 分词

inputs = tokenizer(input_text, return_tensors="pt")

# 模型推理

outputs = model(**inputs)

answer_start_scores = outputs.start_logits

answer_end_scores = outputs.end_logits

answer_start = torch.argmax(answer_start_scores)

answer_end = torch.argmax(answer_end_scores) + 1

answer = tokenizer.convert_tokens_to_string(tokenizer.convert_ids_to_tokens(inputs["input_ids"][0][answer_start:answer_end]))

return answer

该函数将相关知识和问题拼接成一个新的输入文本,然后使用分词器进行分词,将分词结果输入到模型中进行推理,最后提取答案。

5.3 代码解读与分析

优点

结合领域知识:通过将知识图谱中的领域知识融入到模型的输入中,提高了模型在特定领域的推理能力。使用预训练模型:利用预训练的语言模型,减少了模型的训练时间和数据需求。

缺点

实体识别不完善:在

get_related_knowledge

改进方向

引入实体识别模型:使用更准确的实体识别模型,如基于深度学习的命名实体识别模型,自动提取问题中的实体。更新和扩展知识图谱:定期更新和扩展知识图谱,确保其包含最新的领域知识。

6. 实际应用场景

医疗领域

在医疗领域,语言模型的推理能力可以用于疾病诊断、治疗方案推荐等任务。例如,医生可以输入患者的症状和病史,语言模型结合医学知识图谱进行推理,给出可能的疾病诊断和治疗建议。

金融领域

在金融领域,语言模型可以用于风险评估、投资策略推荐等任务。例如,根据市场数据和企业财务报表,语言模型可以推理出企业的信用风险和投资价值。

法律领域

在法律领域,语言模型可以用于法律条文解读、案例分析等任务。例如,律师可以输入法律问题,语言模型结合法律知识图谱进行推理,给出相关的法律条文和案例参考。

教育领域

在教育领域,语言模型可以用于智能辅导、考试评估等任务。例如,学生可以提出学习问题,语言模型结合学科知识图谱进行推理,给出详细的解答和学习建议。

7. 工具和资源推荐

7.1 学习资源推荐

7.1.1 书籍推荐

《自然语言处理入门》:作者何晗,本书系统介绍了自然语言处理的基本概念、算法和应用,适合初学者。《深度学习》:作者Ian Goodfellow、Yoshua Bengio和Aaron Courville,本书是深度学习领域的经典教材,对语言模型的原理和算法有详细的介绍。《知识图谱:方法、实践与应用》:作者王昊奋、漆桂林、陈华钧,本书全面介绍了知识图谱的构建、表示和应用,对于理解领域知识的表示和利用有很大帮助。

7.1.2 在线课程

Coursera上的“Natural Language Processing Specialization”:由斯坦福大学教授授课,涵盖了自然语言处理的各个方面,包括语言模型、文本分类、机器翻译等。edX上的“Deep Learning for Natural Language Processing”:由纽约大学教授授课,重点介绍了深度学习在自然语言处理中的应用,包括Transformer模型和预训练模型。哔哩哔哩上的“自然语言处理入门教程”:由一些知名博主制作,内容通俗易懂,适合初学者快速入门。

7.1.3 技术博客和网站

Hugging Face官方博客:提供了关于语言模型和自然语言处理的最新技术和研究成果。Medium上的“Towards Data Science”:有很多关于自然语言处理和机器学习的高质量文章。机器之心:关注人工智能领域的最新动态和技术发展,有很多关于语言模型的深度报道和分析。

7.2 开发工具框架推荐

7.2.1 IDE和编辑器

PyCharm:一款专业的Python集成开发环境,具有代码编辑、调试、版本控制等功能,适合开发Python项目。Visual Studio Code:一款轻量级的代码编辑器,支持多种编程语言和插件扩展,可用于开发自然语言处理项目。Jupyter Notebook:一种交互式的开发环境,适合进行数据探索、模型训练和实验验证。

7.2.2 调试和性能分析工具

PyTorch Profiler:用于分析PyTorch模型的性能,找出性能瓶颈和优化点。TensorBoard:用于可视化深度学习模型的训练过程和性能指标,方便调试和优化模型。cProfile:Python内置的性能分析工具,可以分析Python代码的执行时间和调用次数。

7.2.3 相关框架和库

Transformers:Hugging Face开发的深度学习框架,提供了丰富的预训练模型和工具,方便开发语言模型应用。SpaCy:一款高效的自然语言处理库,提供了多种语言的处理功能,如分词、词性标注、命名实体识别等。NLTK:自然语言工具包,提供了丰富的语料库和工具,适合进行自然语言处理的基础研究和开发。

7.3 相关论文著作推荐

7.3.1 经典论文

“Attention Is All You Need”:介绍了Transformer模型的原理和结构,是自然语言处理领域的经典论文。“BERT: Pre-training of Deep Bidirectional Transformers for Language Understanding”:提出了BERT模型,开创了预训练语言模型的先河。“Generative Pretrained Transformer 3 (GPT-3): Language Models are Few-Shot Learners”:介绍了GPT-3模型的特点和应用,展示了大规模语言模型的强大能力。

7.3.2 最新研究成果

每年的ACL(Association for Computational Linguistics)、EMNLP(Conference on Empirical Methods in Natural Language Processing)等自然语言处理领域的顶级会议上会有很多关于语言模型推理能力和领域知识融合的最新研究成果。arXiv上也有很多关于语言模型的预印本论文,可以及时了解最新的研究动态。

7.3.3 应用案例分析

一些知名企业和研究机构会发布关于语言模型在实际应用中的案例分析,如谷歌、微软、OpenAI等公司的博客和技术报告。这些案例分析可以帮助我们了解语言模型在不同领域的应用场景和挑战。

8. 总结:未来发展趋势与挑战

未来发展趋势

多模态融合:将语言模型与图像、音频等多模态数据进行融合,提高模型的理解和推理能力。例如,在医疗领域,结合医学影像和文本信息进行疾病诊断。知识增强的预训练:在预训练阶段引入更多的领域知识,使语言模型在初始化时就具备更好的领域理解能力。可解释性推理:提高语言模型推理过程的可解释性,让用户能够理解模型得出结论的依据。例如,使用可视化技术展示知识图谱在推理过程中的作用。

挑战

领域知识获取和更新:获取和更新领域知识是一个持续的挑战,需要建立有效的知识管理机制。计算资源需求:大规模语言模型的训练和推理需要大量的计算资源,如何降低计算成本是一个亟待解决的问题。隐私和安全问题:在处理敏感领域的知识时,如医疗和金融数据,需要确保数据的隐私和安全。

9. 附录:常见问题与解答

如何选择合适的预训练语言模型?

选择合适的预训练语言模型需要考虑以下因素:

任务类型:不同的任务需要不同类型的模型,如问答任务可以选择在问答数据集上微调过的模型。数据规模:如果数据规模较小,可以选择轻量级的模型;如果数据规模较大,可以选择更强大的模型。计算资源:如果计算资源有限,需要选择内存占用较小的模型。

如何评估语言模型的推理能力?

可以使用以下指标评估语言模型的推理能力:

准确率:模型回答正确的问题占总问题数的比例。F1值:综合考虑准确率和召回率的指标,用于评估模型在分类和提取任务中的性能。困惑度:衡量模型对输入文本的概率估计能力,困惑度越低,模型的性能越好。

如何处理知识图谱中的不完整知识?

可以采用以下方法处理知识图谱中的不完整知识:

知识补全:使用知识推理技术,如基于规则的推理和基于机器学习的推理,补全知识图谱中的缺失信息。概率推理:在推理过程中考虑知识的不确定性,使用概率模型进行推理。多源知识融合:结合多个知识图谱或其他数据源,补充不完整的知识。

10. 扩展阅读 & 参考资料

扩展阅读

《人工智能:现代方法》:全面介绍了人工智能的各个领域,包括自然语言处理和机器学习。《Python自然语言处理实战:核心技术与算法》:通过实际案例介绍了Python在自然语言处理中的应用。《数据挖掘:概念与技术》:介绍了数据挖掘的基本概念和算法,对于理解知识图谱的构建和应用有帮助。

参考资料

Hugging Face官方文档:https://huggingface.co/docsrdflib官方文档:https://rdflib.readthedocs.io/ACL Anthology:https://aclanthology.org/arXiv:https://arxiv.org/

暂无评论内容