(一)模型选择

举个例子:预测谁能够还贷款?

得到100个人的信息,其中有5个人在过去的三年内违约了。

惊讶的发现:发现这五个人都穿了蓝色的衬衫。模型也发现了。但是这个特征实则并不是一个有效的信息。由于衣服的颜色实在没什么说服力。

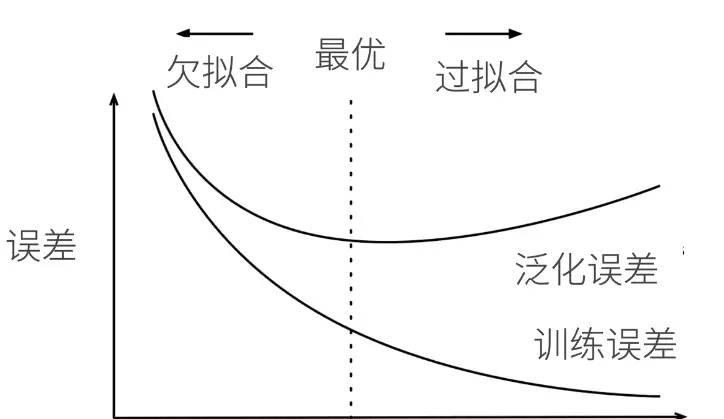

为了进一步讨论这一现象,我们需要了解训练误差和泛化误差。

训练误差(training error)是指,

模型在训练数据集上计算得到的误差。

泛化误差(generalization error)是指,

模型应用在同样从原始样本的分布中抽取的无限多数据样本时,模型误差的期望。

举个例子:根据模考成绩预测未来的考试分数

在过去考试中表现得很好(训练误差),不代表未来考试必定会好(泛化误差)

- 学生A直接把题库背下来了,对了99%

- 学生B是通过自己的分析做对了80%

怎么解决这个问题?

使用两种数据集:验证数据集和测试数据集。

验证集:一个用来评估模型的好坏的数据集

- 例如从训练聚焦拿出50%,作为验证集。

- 不要和训练集混在一起。

测试数据集:只用一次的数据集 - 未来的考试。

- 模型从来没见到过的数据集。

上面说到拿训练集的50%出来作为验证集,可是要是我本来的训练集就少得可怜,你居然还要拿走一半!那我咋训练?(这是常态)

这时候除了数据增强以外可以使用K-则交叉验证

算法:

- 把训练集分割成 K 块。

- 然后for i in [0,1,…, K)循环,每次第i块作为验证集,其余的k-1块作为训练集。

- 计算K次验证集上的平均误差

常把K设置成 5 或者 10 .

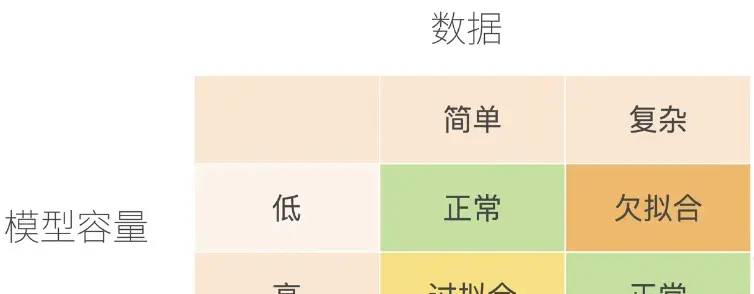

(二)过拟合和欠拟合

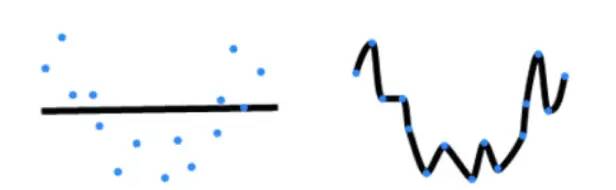

过拟合:我的模型学习的太过了,遇到新的给整不会了。或者说这个庞大的网络直接把你的答案都记住了。

过拟合:模型太小,数据中的有些特征没有学习到。

模型容量(拟合各种函数的能力)

- 低容量的模型难以拟合训练数据

- 高容量的模型可以记住所有的训练数据

VC维

- 统计学习理论中的一个核心思想

- 对于一个分类模型,VC等于一个最大的数据集的大小,不管如何给定标号,都存在一个模型来对它进行完美的分类

- 二维输入的感知机,VC维=3;能够分类任何三个点,但是不能分类四个(xor)

- 支持n为输入的感知机的VC是N+1

- 一些多层感知机的VC维

它提供的是一个理论依据,可以衡量训练误差和泛化误差之间的间隔。但是在深度学习中很少使用,缘由有两个:(1)衡量不准确(2)计算深度学习的VC很困难。

(三)代码实现

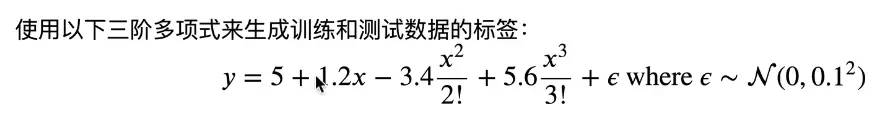

通过多项式分布来拟合交互的探索这些概念

这里只是模拟一下三种不同的情况。如果代码读不懂也没关系。

import math

import numpy as np

import torch

from torch import nn

from d2l import torch as d2l

max_degree = 20

n_train, n_test = 100,100

true_w = np.zeros(max_degree)

true_w[0:4] = np.array([5,1.2,-3.4,5.6])

print(true_w.shape)

# 这里是加噪音环节,不重大

features = np.random.normal(size=(n_train + n_test, 1))

np.random.shuffle(features)

poly_features = np.power(features, np.arange(max_degree).reshape(1, -1))

for i in range(max_degree):

poly_features[:, i] /= math.gamma(i + 1) # gamma(n)=(n-1)!

# labels的维度:(n_train+n_test,)

labels = np.dot(poly_features, true_w)

labels += np.random.normal(scale=0.1, size=labels.shape)

# NumPy ndarray转换为tensor

true_w, features, poly_features, labels = [torch.tensor(x, dtype=

torch.float32) for x in [true_w, features, poly_features, labels]]

def evaluate_loss(net, data_iter, loss): #@save

"""评估给定数据集上模型的损失"""

metric = d2l.Accumulator(2) # 损失的总和,样本数量

for X, y in data_iter:

out = net(X)

y = y.reshape(out.shape)

l = loss(out, y)

metric.add(l.sum(), l.numel())

return metric[0] / metric[1]

def train(train_features, test_features, train_labels, test_labels,

num_epochs=400):

loss = nn.MSELoss(reduction= none )

input_shape = train_features.shape[-1]

# 不设置偏置,由于我们已经在多项式中实现了它

net = nn.Sequential(nn.Linear(input_shape, 1, bias=False))

batch_size = min(10, train_labels.shape[0])

train_iter = d2l.load_array((train_features, train_labels.reshape(-1,1)),

batch_size)

test_iter = d2l.load_array((test_features, test_labels.reshape(-1,1)),

batch_size, is_train=False)

trainer = torch.optim.SGD(net.parameters(), lr=0.01)

animator = d2l.Animator(xlabel= epoch , ylabel= loss , yscale= log ,

xlim=[1, num_epochs], ylim=[1e-3, 1e2],

legend=[ train , test ])

for epoch in range(num_epochs):

d2l.train_epoch_ch3(net, train_iter, loss, trainer)

if epoch == 0 or (epoch + 1) % 20 == 0:

animator.add(epoch + 1, (evaluate_loss(net, train_iter, loss),

evaluate_loss(net, test_iter, loss)))

print( weight: , net[0].weight.data.numpy())

# 从多项式特征中选择前4个维度,即1,x,x^2/2!,x^3/3!

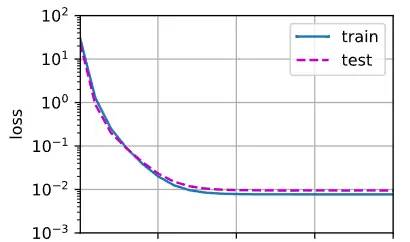

train(poly_features[:n_train, :4], poly_features[n_train:, :4],

labels[:n_train], labels[n_train:])

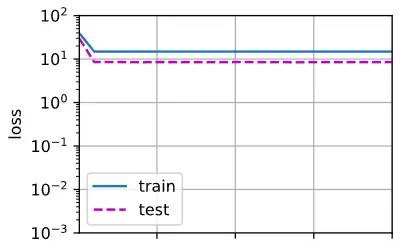

# 从多项式特征中选择前2个维度,即1和x

train(poly_features[:n_train, :2], poly_features[n_train:, :2],

labels[:n_train], labels[n_train:])

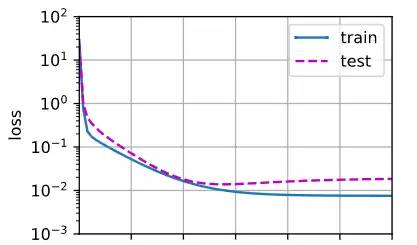

# 从多项式特征中选取所有维度

train(poly_features[:n_train, :], poly_features[n_train:, :],

labels[:n_train], labels[n_train:], num_epochs=1500)

© 版权声明

文章版权归作者所有,未经允许请勿转载。如内容涉嫌侵权,请在本页底部进入<联系我们>进行举报投诉!

THE END

![在苹果iPhone手机上编写ios越狱插件deb[超简单] - 鹿快](https://img.lukuai.com/blogimg/20251123/23f740f048644a198a64e73eeaa43e60.jpg)

暂无评论内容