因最近科研接触到这一块,索性把从2015年周老师发的CAM paper开始的一系列文章做了一个概览,以下全是个人理解,欢迎交流~

每篇文章的详细介绍在许多博客上都有,我就不重复阐述,主要还是以思维导图上的笔记(个人习惯)为主要内容。

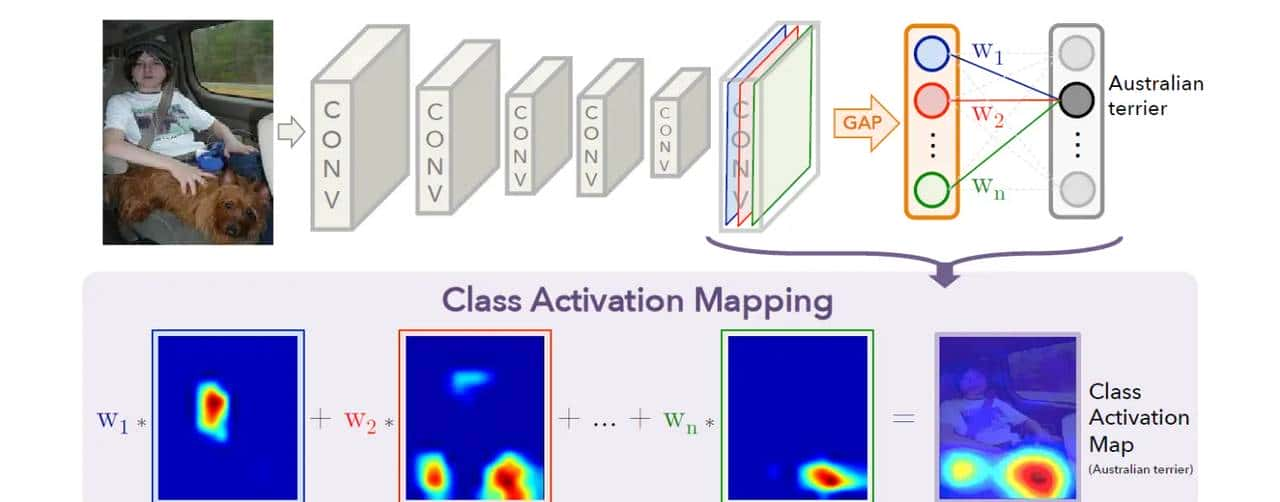

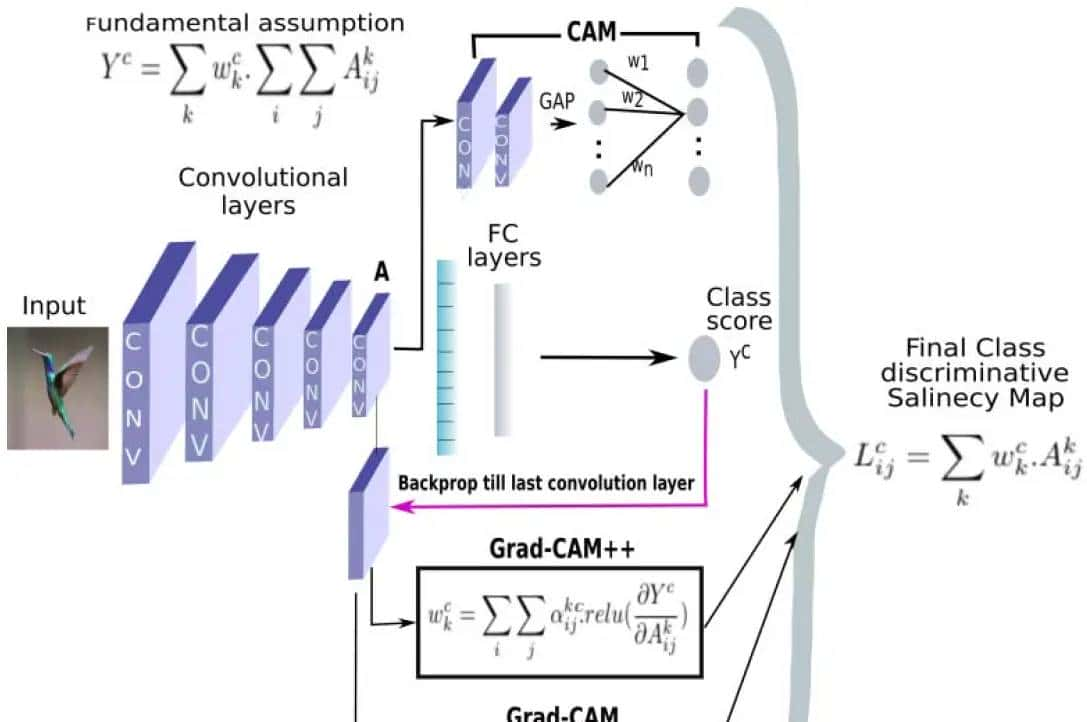

(CVPR2016) features for discriminative localization

提出了一种名为 “class activation mapping”的技术,用于具有GAP的CNN,使得分类训练的CNN能够学习物体定位,而不需要使用任何bounding box

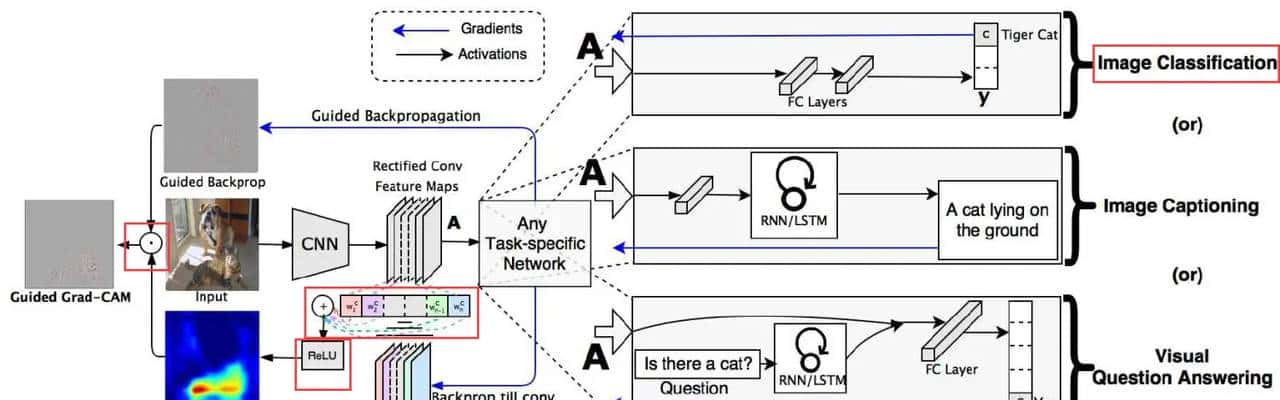

(ICCV2017)Grad-cam: Visual explanations from deep networks via gradient-based localization

出发点:克服CAM需要修改网络结构并对模型进行重新训练

Overview:

总结:克服CAM缺点,从梯度下手得到class-specific的权重,再加权(ReLU)得到Grad-CAM。

疑问:CAM是分类任务下得到的,那能不能反过来约束CAM来提高分类性能呢?使用relu函数是得到positive的pixel,那negative的pixel是不是也有用呢?这两个问题也有学者解决了,分别为以下两篇论文:

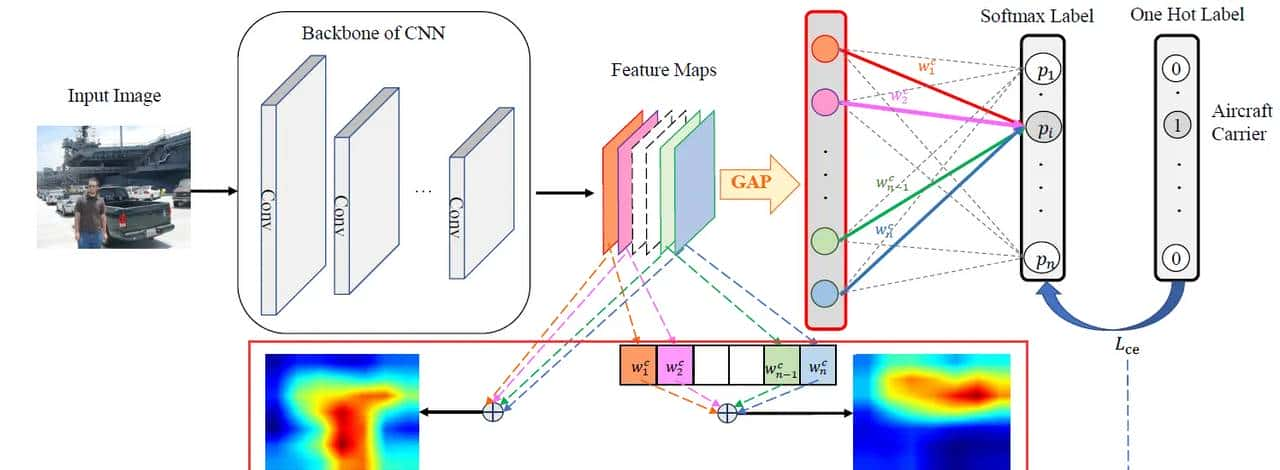

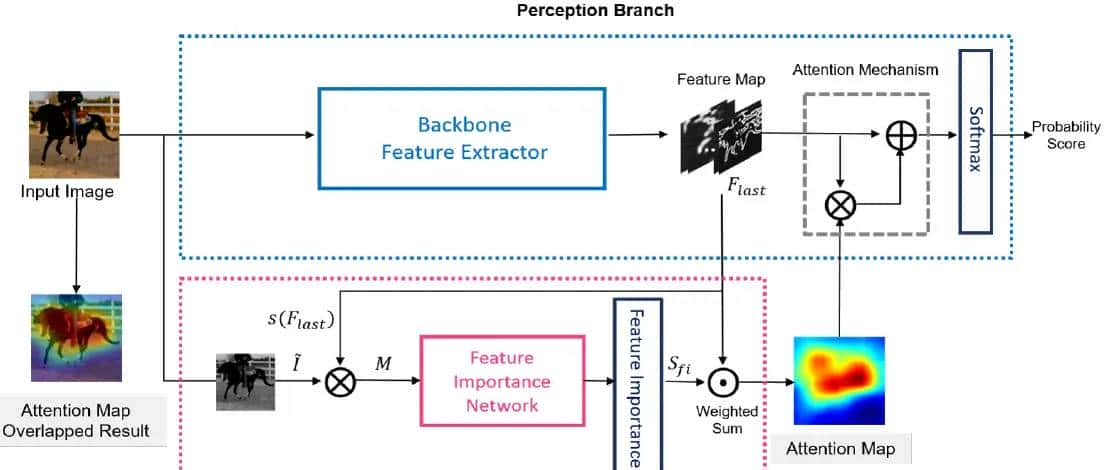

(ICCV2021)Towards Learning Spatially Discriminative Feature Representations

出发点: CAM-loss用CAM来约束嵌入的特征图,驱动主干表达目标类别的特征并抑制非目标类别或背景的特征,从而获得更具判别力的特征表明(CAAM可看作embedding feature map)

总结:抑制与类别信息无关的场景。强制让模型注意力聚焦在对应类别的CAM上,在此CAM上的一个分类。自己教自己应该看哪儿(知识蒸馏)。

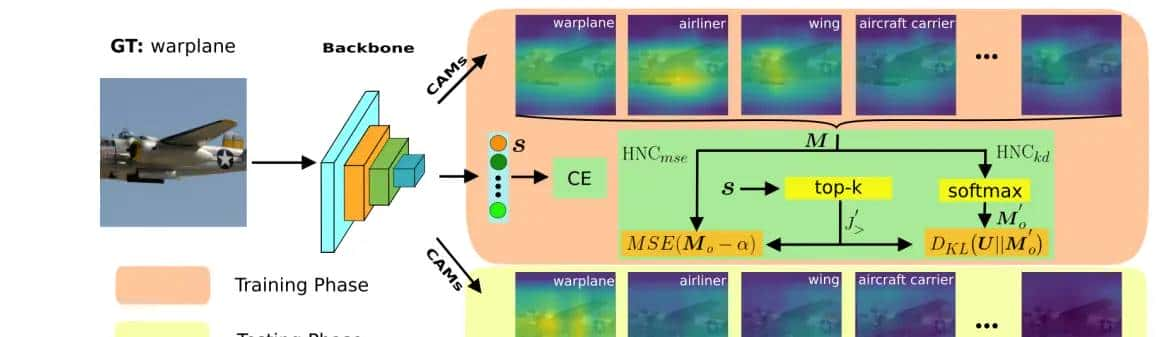

(ECCV2020)Fixing localization errors to improve image classification

出发点:CAM可以用作额外的监督信息,negative class的CAM应该是相对平坦的且没有或很少注意力区域的,因此基于MSE和KL提出了Homogeneous Negative CAM

自我总结:抑制negative class的CAM

(WACV2018)Grad-cam++: Generalized gradient-based visual explanations for deep convolutional networks

出发点:克服Grad-CAM在多个同类目标同时出现不能定位完全的问题,通过对每个像素对最终特征图的贡献建模

总结:从一开始CAM的GAP,到Grad-CAM对feature-map的梯度,再到目前Grad-CAM中feature map每个像素的梯度权重。

疑问:梯度就真的有用吗?不会出错吗?就不存在噪声吗?

Smooth Grad-CAM++

Smooth版本的Grad-CAM++,对工作作用不大,没看

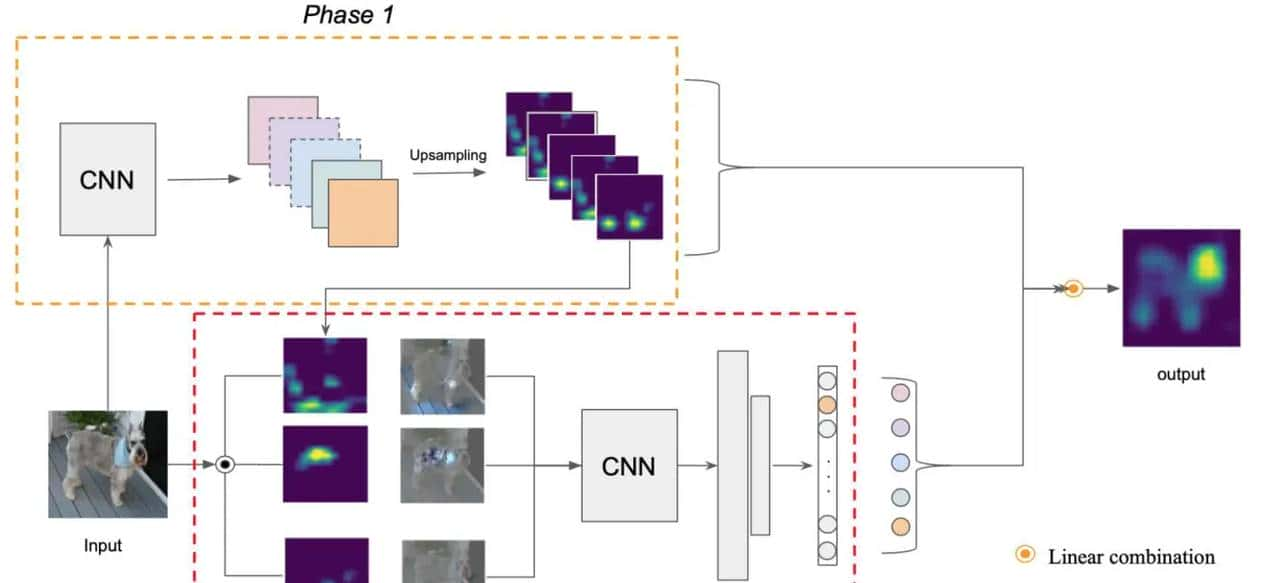

(CVPR2020) Score-cam: Score-weighted visual explanations for convolutional neural

networks

出发点:克服grad-CAM系列中梯度的影响,即梯度大的可能权重小,梯度小的可能权重大。提出通过Channel-wise Increase of Confidence来获得除梯度以外的权重

Overview:

总结:feature map和input相结合的方法可以借鉴

疑问:但pixel为小数值的图像相较于pixel为大数值的图像就没有区分能力了吗?

SS-CAM: Smoothed Score-CAM for Sharper Visual Feature Localization

Smooth版本的Score-CAM,对工作作用不大,没看

(WACV2020) Ablation-CAM: Visual Explanations for Deep Convolutional Network via Gradient-free Localization

跟Score-CAM同时期工作,思路差不多,没细看

(arxiv2020) IS-CAM: Integrated Score-CAM for axiomatic-based explanations

Score-CAM的融合扩展,没看

(ICCV2021) LFI-CAM: Learning Feature Importance for Better Visual Explanation

出发点:为了利用ABN的注意力机制,又防止ABS生成unreliable visual explanation,LFI-CAM的注意力分支将特征图视为掩码,并为每个特征图获得特征importance confidence(Similar with Score-CAM)

Overview:

总结:结合了ABN,来实现提高CAM的准确度,同时也协助了分类性能

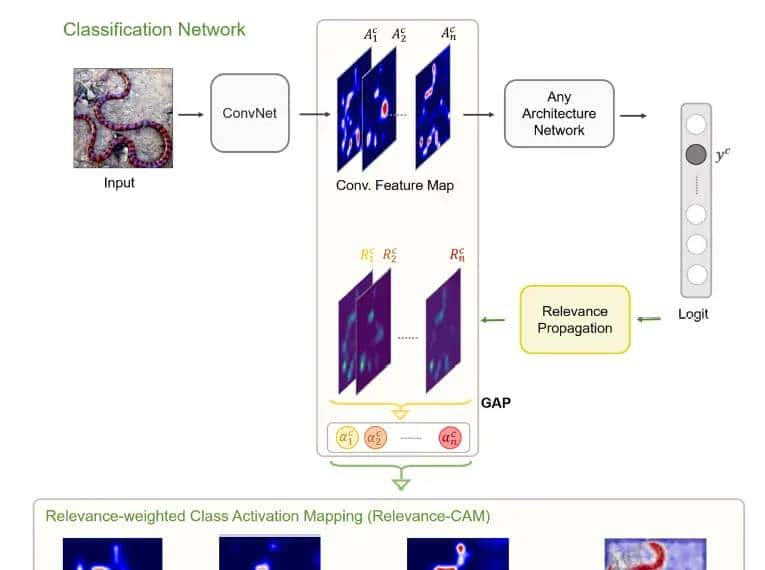

(CVPR2021) Relevance-CAM: Your Model Already Knows Where to Look

没细看。

Overview:

(TIP2021) LayerCAM: Exploring Hierarchical Class Activation Maps for Localization

(ICASSP) INTEGRATED GRAD-CAM: SENSITIVITY-AWARE VISUAL EXPLANATION OF DEEP CONVOLUTIONAL NETWORKS VIA INTEGRATED GRADIENT-BASED SCORING

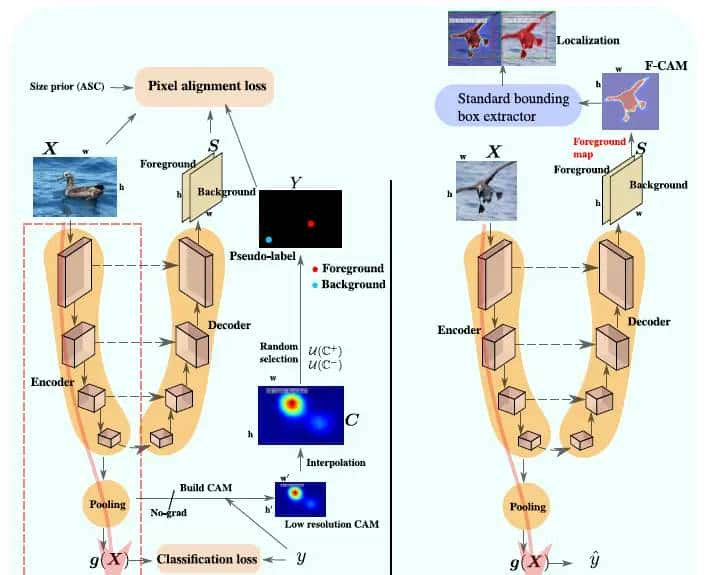

(WACV2021) F-CAM: Full Resolution Class Activation Maps via Guided Parametric Upscaling

出发点:之前的CAM都是low resolution的,即使是用了Interpolation也没有思考到对象的统计性质如颜色纹理等,F-CAM能构建full resolution的CAM

Overview:

内容是否要补充完整看后来的缘分吧,或者看评论需求。

时间:二零二二年二月二十二日。作者:逃学卡夫卡。声明:版权所有,侵权必究。

暂无评论内容